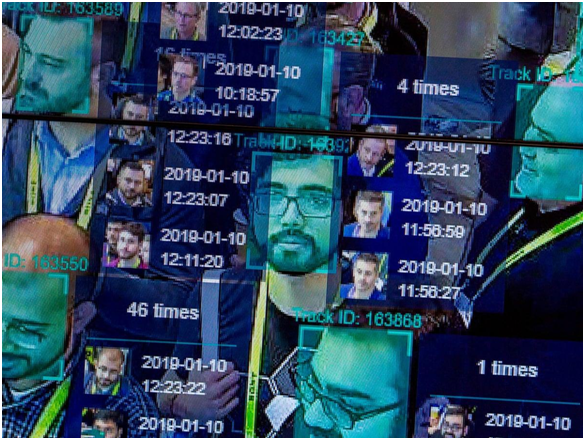

Veido atpažinimo technologija ir jos gebėjimai išaugo toli už mūsų vaizduotės nuo tada, kai išpopuliarėjo nauji algoritmai, sustiprinantys šią technologiją teisėsaugoje. Šiuo metu veidų atpažinimo technologiją teisėsaugos pajėgos naudoja žemiausiuose duomenų rinkimo procesų lygiuose, kad nustatytų nusikaltėlius per gausius susibūrimus. Technika naudoja vaizdo stebėjimo kamerų filmuotą medžiagą viešose vietose ir gatvėse, o surinktus duomenis paleidžia agentūros archyvuose, kad nustatytų veidą, ieškomą dėl nusikalstamų veikų.

Ši technologija buvo integruota į mažiausius įtaisus, įskaitant mobiliuosius telefonus ir išmaniuosius nešiojamus įrenginius. Taigi jis ne tik saugo jus gatvėse, bet ir siekia apsaugoti jūsų asmeninę informaciją, saugomą jūsų išmaniuosiuose įrenginiuose. „Faceprint“ naudojimas rinkodaros ir reklamos praktikai tapo įprastas šiuolaikiniame socialinės žiniasklaidos kampanijų amžiuje. Ir tada yra privatus stebėjimas prekybos centruose, mažmeninės prekybos parduotuvėse ir kt.

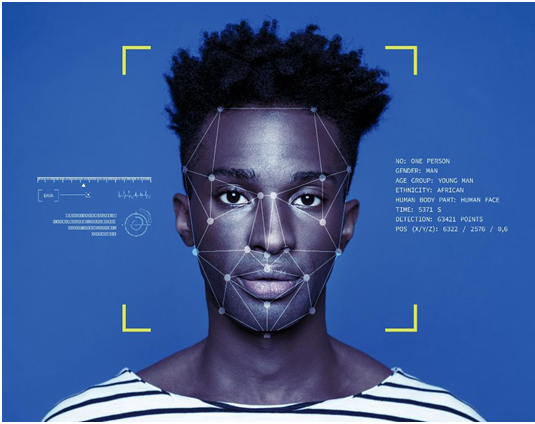

Iš šios perspektyvos galima greitai atkreipti dėmesį į neabejotinus veido atpažinimo technologijos pranašumus. Tačiau jis taip pat buvo kruopščiai ištirtas dėl grėsmės, kurią ji kelia vartotojų privatumui, duomenų apsaugai ir, žinoma, skaidrumui tarp įstatymų ir visuomenės. Gerai žinoti apie tokios invazinės technologijos pranašumus ir trūkumus. Tačiau yra dar vienas veido atpažinimo technologijos trūkumas, kurį žmonės, atrodo, ignoruoja, tai yra rasinis profiliavimas ir rasinė diskriminacija .

Šiame kūrinyje apžvelgsime, kaip ši technologija skatina rasinį šališkumą ir diskriminaciją ir kokios rimtos tokios invazinės technologijos pasekmės.

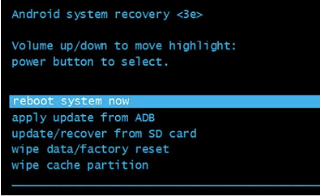

Kaip veikia veido atpažinimas?

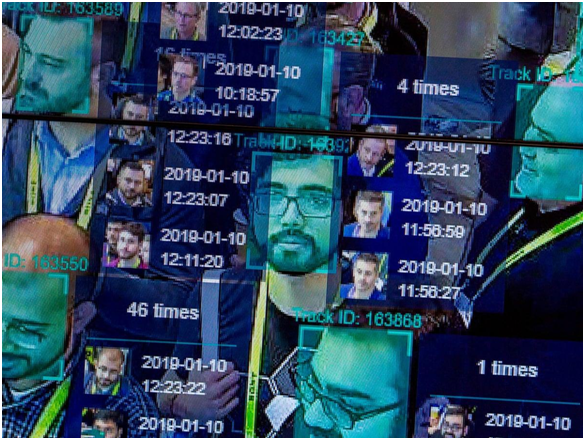

Vaizdo šaltinis: National Post

1 veiksmas: jūsų nuotrauka nufotografuojama iš fotoaparato, paskyros, el. pašto ir kt. Tai yra tiesioginė profilio nuotrauka arba atsitiktinė minia.

2 veiksmas: veido atpažinimo programinė įranga paleidžia jūsų veidą per saugomų veido atspaudų duomenų bazę. Veido atspaudas renkamas naudojant geometrinį jūsų veido stebėjimą.

3 veiksmas: naudojant algoritmą, pagal kurį nustatomas, nustatomas jūsų nuotraukos atitikimo procentas su bet kokiu žinomu veido atspaudu.

Automatizavimo šališkumas: vienas iš daugelio veido atpažinimo technologijų trūkumų

Automatizavimo poslinkis arba mašinos poslinkis reiškia scenarijų, kai mašinos algoritmas rodo tam tikrą įvesties duomenų poslinkį, todėl gaunama nepalanki išvestis. Taip nutinka, kai yra klaida algoritmo kode, trūksta saugomų duomenų rinkinių kalibravimui, neteisingos įvesties reikšmės arba per daug įvesties duomenų, kurių kalibruoti nebegali mašinos.

Kaip rasinis profiliavimas dera su visa tai?

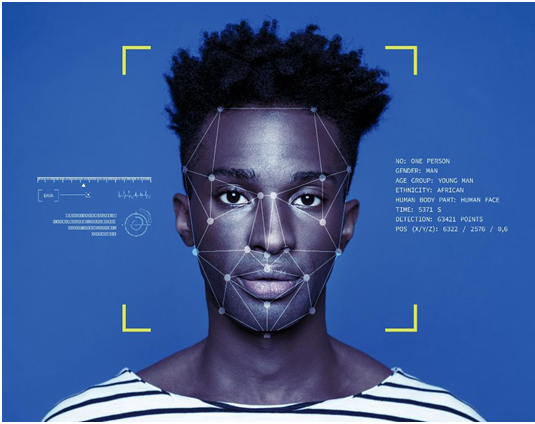

Vaizdo šaltinis: The Guardian

Pradėkime nuo senovinio įvykio, kuris tuo metu buvo laikomas nereikšmingu. 2001 m. Tampa City naudojo veido atpažinimo programinę įrangą perpildytam miestui stebėti, nes turistai užplūdo miesto gatves dėl 2001 m. „Super Bowl“. Remiantis New York Times ataskaita , programinė įranga nustatė 19 žmonių, kurie tariamai turėjo neįvykdytus orderius prieš juos; tačiau nebuvo suimta, nes dėl stadiono infrastruktūros nebuvo įmanoma pasiekti nustatytų kaltininkų tarp didžiulės minios.

Nors šiuo konkrečiu atveju rasinio profiliavimo požymių niekur nebuvo matyti, tai buvo pirmas kartas, kai sekimo metodai buvo naudojami prieš piliečių laisvių ir asmenų privatumo pažeidimus. Per ateinančius metus Tampos policija atsisakė šių stebėjimo sistemų, remdamasi nepatikimais rezultatais.

Vaizdo šaltinis: ICO

Perkeldamas į kiek naujesnį scenarijų, Ali Brelandas „The Guardian“ pranešė apie Willie'io Lyncho, juodaodžio, apkaltinto liūdnai pagarsėjusiu narkotikų prekeiviu, areštą Brentvudo rajone, kuriame daugiausia yra spalvotų žmonių. Vienintelis įrodymas prieš Lynchą buvo jo nuotraukos mobiliajame telefone, kurios buvo patikrintos policijos duomenų bazėje, kol policija jį nustatė kaltininku. Lynchas buvo nuteistas aštuoneriems metams, o dabar jis apskundė nuosprendį. Nesvarbu, ar jis buvo tariamas prekiautojas, ar ne, neišvengiamai kyla susirūpinimas, ar užtenka tik mašininio rezultato, kad būtų patvirtintas bet kurio tiriamojo nuosprendis?

2019 m., kaip „The Guardian“ pranešė Tomas Perkinsas , Detroito policija tariamai per pastaruosius dvejus metus naudojo veido atpažinimo priemones. Detroitas yra vieta, kur daugiau nei 80% gyventojų yra juodaodžiai. Detroito policijos komisijos juodaodžio nario pareiškimas išreiškė susirūpinimą dėl tokios praktikos. Jis sakė, kad juodaodžiai turi bendrą veido bruožą, kuris kelia pavojų sistemos algoritmui, vadindamas tai „technorasizmu“.

Vaizdo šaltinis: Vox

Fabio Bacchini ir Ludovica Lorusso 2019 m. žurnale „Journal of Information Communication and Ethics Society“ atliktame tyrime buvo nustatyta, kad šios biometrinės ir veido atpažinimo sistemos nėra 100% patikimos teisėsaugai. Be to, rasinė diskriminacija turėjo neigiamą poveikį visoms tokioms sistemoms, o tai turi papildomų atvirkštinių socialinių padarinių. Tyrimas buvo ypač skirtas Vakarų visuomenėms, kur tokios sistemos plačiai naudojamos stebėjimui.

Tai tik trys iš daugelio tokių pavyzdžių, kai išryškėjo veido atpažinimo sistemų sukelti rasiniai skirtumai. Tačiau kodėl šios sistemos yra tokios nekompetentingos, nepaisant tokio augančio algoritminio kodavimo technologijos atnaujinimo tikslumo.

Baltųjų viršenybė Vakarų valstijose: baltųjų dominuojanti technologijų pramonė

Nustatyta, kad 2014 m. dauguma technologijų įmonių, įskaitant milžiną „Apple Inc.“, samdo daugiausia baltaodžius vyrus. „Apple“ įmonėje 55% darbuotojų buvo baltieji, o „Apple“ vadovybė sudarė 63% baltųjų darbuotojų. Bendrovės, kurios pasidalino panašiomis įvairovės ataskaitomis, taip pat buvo „ Facebook“ , „Google“ ir „Twitter“. Po penkerių metų Wired ataskaitoje buvo atskleista, kad šie skaičiai pagerėjo minimaliai.

Nors „Facebook“ skaičius gerokai pagerėjo, „Apple“ juodaodžių techninių darbuotojų procentas nepakito ir sudarė tik 6% visos darbo jėgos. „Amazon“ buvo vienintelė organizacija, kuri savo biuruose JAV registravo 42% juodaodžių arba Lotynų Amerikos darbuotojų.

Ką reiškia ši statistika? JAV dauguma programuotojų, kurie yra priskirti dideliems projektams, tokiems kaip stebėjimo sistemų algoritmų kūrimas, yra balti. Tai žmonės, kurie priima svarbiausius sprendimus dėl produkto ar paslaugos, kurią ketina pristatyti / pristatyti įmonė. Vadinasi, galutiniame kūrime atsižvelgiama į jų perspektyvas, požiūrį ir mąstymo procesus. Tai nereiškia, kad baltieji yra rasistai ir sąmoningai sukūrė tokias stebėjimo sistemas . NE!

Vaizdo šaltinis: Forbes

Kai baltaodis vaikinas kuria veido atpažinimo algoritmą ir jam konsultuoja/padeda tik baltaodžiai kolegos, prieš užbaigdami kodą jie neatsižvelgia į kitos spalvos veido bruožus. Kadangi technologijų pramonėje dominuoja baltieji inžinieriai, duomenų archyvus, naudojamus ruošiant pradinį kodą, taip pat kuria ir kalibruoja baltieji technikai. Taigi pats kodas sukuriamas nukrypstant nuo pagrindinio skaičiavimo algoritmo, dėl kurio atsiranda šie rasiniai stebėjimo rezultatų skirtumai.

Kodas tiesiog sužino, ką jame įkūnija baltieji žmonės. Nėra jokios kitos spalvos žmogaus perspektyvos ar indėlio.

Kalibravimo problemos

Amerikos teisėsauga labai priklauso nuo stebėjimo ir duomenų sekimo. Buvo daug atvejų, kai pranešėjai išstumdavo informaciją apie neteisėtą civilių gyventojų sekimą. Vienas iš tokių pavyzdžių yra Edwardo Snowdeno atskleidimas apie neteisėtą NSA sekimą.

Vaizdo šaltinis: CBS Local

Šios stebėjimo programos palaikomos milijonų piliečių veido atspaudais ir kita asmenine informacija. Jei atsižvelgsime tik į veido atspaudus, milijonai amerikiečių atvirai dalijasi nuotraukomis socialinės žiniasklaidos platformose. Tada kiekvienoje tautos gatvėje yra vaizdo stebėjimo kamerų , kurios siūlo tiesioginį šimtų tūkstančių praeivių kadrą. Šiuo metu policijos duomenų bazėse yra apie 117 milijonų vaizdų, o FTB turi daugiau nei 400 milijonų duomenų rinkinių, skirtų kalibruoti stebėjimo veido atpažinimo algoritmuose.

Dabar įsivaizduokite, kad šie duomenų rinkiniai palyginami su vienu vaizdu, kuriame gali būti užfiksuoti visi konkretaus asmens veido bruožai. Esant tokiam scenarijui, gali atsirasti klaidų. Yra tiesiog per daug duomenų, kad būtų galima juos suprasti ir paleisti pagal vieną veido atspaudą. Joks algoritmas negali garantuoti šimtaprocentinio rezultato užtikrinimo, kai kalibravimas toks sudėtingas. Tai galiausiai prisideda prie rasinio profiliavimo, kurį sukelia veido atpažinimo technologija.

Didžiulis veido atpažinimo patikimumas

Vaizdo šaltinis: NY Post

Willie'io Lyncho atvejis primena, kad veido atpažinimas neturėtų būti vienintelis patikimas metodas, pateikiamas kaip įrodymas, kai kalbama apie teisėsaugą. Dėl šios priežasties Tampos miesto policija atsisakė technologijų.

Tiesa, veido atpažinimas yra puikus kurortas ir padeda policijai. Bostono maratono bombardavimo kaltininkai buvo atpažinti atlikus išsamią ir išsamią stebėjimo įrašų analizę. Tačiau tai negali būti vienintelis įrodymas ką nors nuteisti. Turi būti patvirtinančių įrodymų, patvirtinančių veido atpažinimo algoritmų rezultatus, o prieš priimant galutinį sprendimą reikia atsižvelgti į automatizavimo šališkumo koncepciją.

Aparatinės įrangos problemos: veido atpažinimas mobiliuosiuose įrenginiuose ir fotoaparatuose

Vaizdo šaltinis: TechCrunch

Stebėjimo kamerų sistemas ir susijusią techninę bei programinę įrangą kuria ne viena įmonė. Tai milijardų dolerių vertės pramonė, kurioje dešimtys korporacijų konkuruoja dėl sutarčių iš teisėsaugos institucijų. Daugelis šių sistemų yra Kinijos gamintojų. Viskas apie tai, kaip įsigyti pigiausių technologijų su geriausiomis savybėmis. Taip dažniausiai ir veikia. Todėl visada yra skirtingų sistemų kalibravimo skirtumų, taip pat stebėjimo rezultatų kokybės skirtumų tikimybė. Daugelis kamerų stebėjimo algoritmų yra neveiksmingi kalibruojant spalvotų žmonių vaizdus vien dėl techninio nekompetencijos, taip šlovinant rasinę diskriminaciją.

Techninės problemos, sukeliančios rasizmą naudojant veido atpažinimą, taip pat buvo pastebėtos naudojant „Apple Face Lock“ funkciją. Atvejis iš Kinijos pašalino tai, kad „iPhone X“ veido užraktas negalėjo atskirti dviejų skirtingų Kinijos kolegų, todėl ši funkcija buvo nenaudinga. Panašūs pranešimai buvo atmesti, nurodant problemas, susijusias su dviejų juodaodžių atskyrimu vienas nuo kito. Kaip minėta pirmiau, „Apple“ techninėse komandose turi tik 6% juodaodžių. Tai aiškus pavyzdys, kaip veido atpažinimo technologija gali skatinti rasizmą net mūsų nešiojamuose įrenginiuose.

Išvada

Taip, veido atpažinimas yra rasistinis, ir tai dabar žinoma. Nors technologija kasdien tobulėja, kad ištaisytų tokias problemas, rezultatai yra vienodi. Technologijos turėtų suvienyti pasaulį, siekdamos bendrų techninės pažangos ir plėtros tikslų, tačiau kai kurios technikos tiesiog kenkia rasinei ir bendruomeninei harmonijai.

Šiuo metu geriausia, ką teisėsaugos pareigūnai gali padaryti, tai neparemti savo bylų, pagrįstų algoritminio kalibravimo įrodymais, kurie net nėra patikimi. Be to, pats laikas rimtai žiūrėti į įvairovę ir įtrauktį darbo vietose, kad visų etninių grupių žmonės galėtų susiburti ir sukurti produktą, kuriame nėra rasinių skirtumų. Pasaulyje yra tūkstančiai rasių, o žmonės atmetė rasinius skirtumus, kurie taip ilgai persekiojo pasaulinę visuomenę. Jei tai būtina išlaikyti, mašinos, kuriomis mes taip pasitikime, turi būti mokomos to paties.