Alapfogalmak

Kubernetes klaszter

Telepítés

Tesztelje Kubernetes szerverét

Példa: Selenium rács telepítése Kubernetes használatával

Öngyógyítás

A szelénrács méretezése

A Kubernetes egy nyílt forráskódú platform, amelyet a Google fejlesztett ki a konténeres alkalmazások kezelésére szerverfürtökön keresztül. A Google másfél évtizedes tapasztalatára épít a konténerfürtök nagyszabású futtatásával kapcsolatban , és a fejlesztők számára Google-stílusú infrastruktúrát biztosít, kihasználva a legjobb nyílt forráskódú projekteket, például:

- Docker : alkalmazástároló technológia.

- Etcd : egy elosztott kulcsérték-adattár, amely a fürtszintű információkat kezeli és szolgáltatásfelderítést biztosít.

- Flanel : egy átfedő hálózati szövet, amely lehetővé teszi a konténerek összekapcsolását több szerver között.

A Kubernetes lehetővé teszi a fejlesztők számára, hogy YAML- fájlokon és absztrakciókon, például podokon, RC-ken és szolgáltatásokon keresztül deklaratívan meghatározzák alkalmazási infrastruktúrájukat (erről később bővebben), és biztosítja, hogy az alapul szolgáló fürt mindig megfeleljen a felhasználó által meghatározott állapotnak.

Néhány jellemzője a következőket tartalmazza:

- A rendszererőforrások automatikus ütemezése és az alkalmazástárolók automatikus elhelyezése egy fürtben.

- Az alkalmazások menet közbeni méretezése egyetlen paranccsal.

- Folyamatos frissítések nulla állásidővel.

- Öngyógyítás: egy alkalmazás automatikus átütemezése, ha a szerver meghibásodik, a tárolók automatikus újraindítása, állapotellenőrzés.

Ugorjon szerelése ha már ismeri Kubernetes.

Alapfogalmak

A Kubernetes a következő absztrakciókat (logikai egységeket) kínálja a fejlesztőknek:

- Hüvelyek.

- Replikációs vezérlők.

- Címkék.

- Szolgáltatások.

Hüvelyek

Ez a Kubernetes munkaterhelések alapegysége. A pod egy alkalmazás-specifikus "logikai gazdagépet" modellez konténeres környezetben. Laikus kifejezéssel olyan alkalmazások vagy szolgáltatások csoportját modellezi, amelyek korábban ugyanazon a szerveren futottak a konténer előtti világban. A podban lévő tárolók ugyanazon a hálózati névteren osztoznak, és adatmennyiséget is megoszthatnak.

Replikációs vezérlők

A podok kiválóan alkalmasak több tároló logikai alkalmazási egységekre történő csoportosítására, de nem kínálnak replikációt vagy átütemezést szerverhiba esetén.

Itt jön jól egy replikációs vezérlő vagy RC. Az RC biztosítja, hogy egy adott szolgáltatás számos podja mindig fut a fürtön keresztül.

Címkék

Ezek kulcsértékű metaadatok, amelyek bármely Kubernetes-erőforráshoz (pod-ok, RC-k, szolgáltatások, csomópontok stb.) csatolhatók.

Szolgáltatások

A pod-ok és a replikációs vezérlők nagyszerűek az alkalmazások fürtön belüli üzembe helyezésére és elosztására, de a pod-ok átmeneti IP-címekkel rendelkeznek, amelyek az átütemezés vagy a tároló újraindításakor megváltoznak.

A Kubernetes szolgáltatás stabil végpontot biztosít (rögzített virtuális IP + port-kötés a gazdagép kiszolgálókhoz) a replikációs vezérlő által kezelt pod-csoportok számára.

Kubernetes klaszter

A legegyszerűbb formájában a Kubernetes-fürt kétféle csomópontból áll:

- 1 Kubernetes mester.

- N Kubernetes csomópont.

Kubernetes mester

A Kubernetes master a teljes fürt vezérlőegysége.

A mester fő összetevői a következők:

- Etcd: egy globálisan elérhető adattár, amely információkat tárol a fürtről és a fürtön futó szolgáltatásokról és alkalmazásokról.

- Kube API-kiszolgáló: ez a Kubernetes-fürt fő felügyeleti központja, és egy RESTful felületet tesz közzé.

- Vezérlőkezelő: kezeli a replikációs vezérlők által kezelt alkalmazások replikációját.

- Ütemező: nyomon követi az erőforrás-kihasználást a fürtben, és ennek megfelelően rendeli hozzá a munkaterheléseket.

Kubernetes csomópont

A Kubernetes-csomópont olyan munkakiszolgálók, amelyek a pod-ok futtatásáért felelősek.

A csomópont fő összetevői a következők:

- Docker: egy démon, amely podokban definiált alkalmazástárolókat futtat.

- Kubelet: vezérlő egység a podokhoz egy helyi rendszerben.

- Kube-proxy: hálózati proxy, amely biztosítja a Kubernetes-szolgáltatások helyes útválasztását.

Telepítés

Ebben az útmutatóban egy 3 csomópontból álló klasztert hozunk létre CentOS 7 szerverek használatával:

- 1 Kubernetes master (kube-master)

- 2 Kubernetes csomópont (kube-node1, kube-node2)

A későbbiekben tetszőleges számú további csomópontot adhat hozzá, ugyanazt a telepítési eljárást követve a Kubernetes-csomópontokhoz.

Minden csomópont

Állítsa be a gazdagépneveket és /etc/hosts:

# /etc/hostname

kube-master

# or kube-node1, kube-node2

# append to /etc/hosts

replace-with-master-server-ip kube-master

replace-with-node1-ip kube-node1

replace-with-node2-ip kube-node2

Tűzfal letiltása:

systemctl disable firewalld

systemctl stop firewalld

Kubernetes mester

Telepítse a Kubernetes főcsomagokat:

yum install etcd kubernetes-master

Konfiguráció:

# /etc/etcd/etcd.conf

# leave rest of the lines unchanged

ETCD_LISTEN_CLIENT_URLS="http://0.0.0.0:2379"

ETCD_LISTEN_PEER_URLS="http://localhost:2380"

ETCD_ADVERTISE_CLIENT_URLS="http://0.0.0.0:2379"

# /etc/kubernetes/config

# leave rest of the lines unchanged

KUBE_MASTER="--master=http://kube-master:8080"

# /etc/kubernetes/apiserver

# leave rest of the lines unchanged

KUBE_API_ADDRESS="--address=0.0.0.0"

KUBE_ETCD_SERVERS="--etcd_servers=http://kube-master:2379"

Start stb.:

systemctl start etcd

Telepítse és konfigurálja a Flanel overlay hálózati szövetet (erre azért van szükség, hogy a különböző szervereken futó tárolók lássák egymást):

yum install flannel

Hozzon létre egy flanel konfigurációs fájlt ( flannel-config.json):

{

"Network": "10.20.0.0/16",

"SubnetLen": 24,

"Backend": {

"Type": "vxlan",

"VNI": 1

}

}

Állítsa be a Flanel konfigurációt az Etcd szerveren:

etcdctl set coreos.com/network/config < flannel-config.json

Irányítsa a Flannelt az Etcd szerverre:

# /etc/sysconfig/flanneld

FLANNEL_ETCD="http://kube-master:2379"

Engedélyezze a szolgáltatásokat, hogy azok rendszerindításkor elinduljanak:

systemctl enable etcd

systemctl enable kube-apiserver

systemctl enable kube-controller-manager

systemctl enable kube-scheduler

systemctl enable flanneld

Indítsa újra a szervert.

Kubernetes csomópont

Telepítse a Kubernetes csomópontcsomagokat:

yum install docker kubernetes-node

A következő két lépés a Dockert úgy konfigurálja, hogy overlayfeket használjon a jobb teljesítmény érdekében. További információért látogassa meg ezt a blogbejegyzést :

Törölje az aktuális docker tárolókönyvtárat:

systemctl stop docker

rm -rf /var/lib/docker

Konfigurációs fájlok módosítása:

# /etc/sysconfig/docker

# leave rest of lines unchanged

OPTIONS='--selinux-enabled=false'

# /etc/sysconfig/docker

# leave rest of lines unchanged

DOCKER_STORAGE_OPTIONS=-s overlay

Állítsa be a kube-node1-et a korábban beállított mester használatára:

# /etc/kubernetes/config

# leave rest of lines unchanged

KUBE_MASTER="--master=http://kube-master:8080"

# /etc/kubernetes/kubelet

# leave rest of the lines unchanged

KUBELET_ADDRESS="--address=0.0.0.0"

# comment this line, so that the actual hostname is used to register the node

# KUBELET_HOSTNAME="--hostname_override=127.0.0.1"

KUBELET_API_SERVER="--api_servers=http://kube-master:8080"

Telepítse és konfigurálja a Flanel overlay hálózati szövetet (ismét – ez azért szükséges, hogy a különböző szervereken futó konténerek lássák egymást):

yum install flannel

Irányítsa a Flannelt az Etcd szerverre:

# /etc/sysconfig/flanneld

FLANNEL_ETCD="http://kube-master:2379"

Szolgáltatások engedélyezése:

systemctl enable docker

systemctl enable flanneld

systemctl enable kubelet

systemctl enable kube-proxy

Indítsa újra a szervert.

Tesztelje Kubernetes szerverét

Miután az összes kiszolgáló újraindult, ellenőrizze, hogy a Kubernetes-fürt működik-e:

[root@kube-master ~]# kubectl get nodes

NAME LABELS STATUS

kube-node1 kubernetes.io/hostname=kube-node1 Ready

kube-node2 kubernetes.io/hostname=kube-node2 Ready

Példa: Selenium rács telepítése Kubernetes használatával

A Selenium egy keretrendszer a böngészők tesztelési célú automatizálására. Ez minden webfejlesztő arzenáljának hatékony eszköze.

A Selenium grid lehetővé teszi a tesztek méretezhető és párhuzamos távoli végrehajtását a központi Selenium hubhoz csatlakoztatott Selenium csomópontok klaszterén keresztül.

Since Selenium nodes are stateless themselves and the amount of nodes we run is flexible, depending on our testing workloads, this is a perfect candidate application to be deployed on a Kubernetes cluster.

In the next section, we'll deploy a grid consisting of 5 application containers:

- 1 central Selenium hub that will be the remote endpoint to which our tests will connect.

- 2 Selenium nodes running Firefox.

- 2 Selenium nodes running Chrome.

Deployment strategy

To automatically manage replication and self-healing, we'll create a Kubernetes replication controller for each type of application container we listed above.

To provide developers who are running tests with a stable Selenium hub endpoint, we'll create a Kubernetes service connected to the hub replication controller.

Selenium hub

Replication controller

# selenium-hub-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-hub

spec:

replicas: 1

selector:

name: selenium-hub

template:

metadata:

labels:

name: selenium-hub

spec:

containers:

- name: selenium-hub

image: selenium/hub

ports:

- containerPort: 4444

Deployment:

[root@kube-master ~]# kubectl create -f selenium-hub-rc.yaml

replicationcontrollers/selenium-hub

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 0 50s

[root@kube-master ~]# kubectl describe pod selenium-hub-pilc8

Name: selenium-hub-pilc8

Namespace: default

Image(s): selenium/hub

Node: kube-node2/45.63.16.92

Labels: name=selenium-hub

Status: Running

Reason:

Message:

IP: 10.20.101.2

Replication Controllers: selenium-hub (1/1 replicas created)

Containers:

selenium-hub:

Image: selenium/hub

State: Running

Started: Sat, 24 Oct 2015 16:01:39 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 16:01:02 +0000 Sat, 24 Oct 2015 16:01:02 +0000 1 {scheduler } scheduled Successfully assigned selenium-hub-pilc8 to kube-node2

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD pulled Successfully pulled Pod container image "gcr.io/google_containers/pause:0.8.0"

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD created Created with docker id 6de00106b19c

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD started Started with docker id 6de00106b19c

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers pulled Successfully pulled image "selenium/hub"

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers created Created with docker id 7583cc09268c

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers started Started with docker id 7583cc09268c

Itt láthatjuk, hogy a Kubernetes a szelén-hub tárolómat a kube-node2-re helyezte.

Szolgáltatás

# selenium-hub-service.yaml

apiVersion: v1

kind: Service

metadata:

name: selenium-hub

spec:

type: NodePort

ports:

- port: 4444

protocol: TCP

nodePort: 30000

selector:

name: selenium-hub

Telepítés:

[root@kube-master ~]# kubectl create -f selenium-hub-service.yaml

You have exposed your service on an external port on all nodes in your

cluster. If you want to expose this service to the external internet, you may

need to set up firewall rules for the service port(s) (tcp:30000) to serve traffic.

See http://releases.k8s.io/HEAD/docs/user-guide/services-firewalls.md for more details.

services/selenium-hub

[root@kube-master ~]# kubectl get services

NAME LABELS SELECTOR IP(S) PORT(S)

kubernetes component=apiserver,provider=kubernetes <none> 10.254.0.1 443/TCP

selenium-hub <none> name=selenium-hub 10.254.124.73 4444/TCP

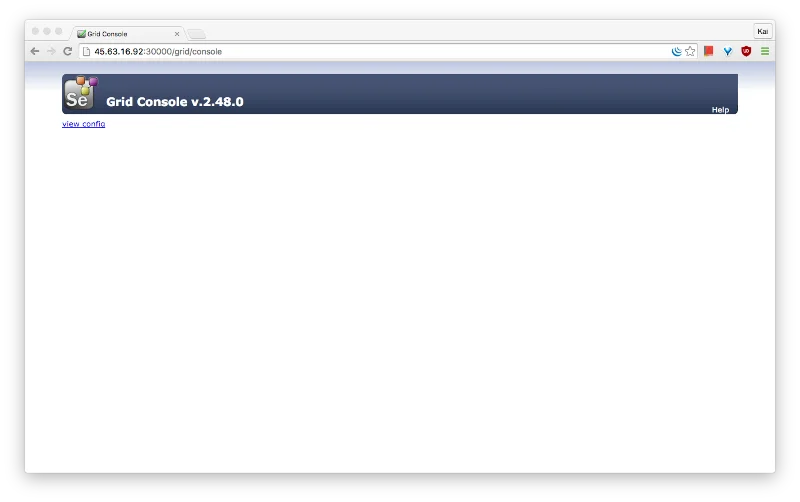

A szolgáltatás üzembe helyezése után a következő címről érhető el:

- Bármely Kubernetes-csomópont a 10.254.124.73 virtuális IP-címen és a 4444-es porton keresztül.

- Külső hálózatok bármely Kubernetes-csomópont nyilvános IP-címén keresztül, a 30000-es porton.

![A Kubernetes használatának első lépései a CentOS 7 rendszeren A Kubernetes használatának első lépései a CentOS 7 rendszeren]() (egy másik Kubernetes csomópont nyilvános IP-címét használva)

(egy másik Kubernetes csomópont nyilvános IP-címét használva)

Szelén csomópontok

Firefox csomópont-replikációs vezérlő:

# selenium-node-firefox-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-node-firefox

spec:

replicas: 2

selector:

name: selenium-node-firefox

template:

metadata:

labels:

name: selenium-node-firefox

spec:

containers:

- name: selenium-node-firefox

image: selenium/node-firefox

ports:

- containerPort: 5900

env:

- name: HUB_PORT_4444_TCP_ADDR

value: "replace_with_service_ip"

- name: HUB_PORT_4444_TCP_PORT

value: "4444"

Telepítés:

Cserélje replace_with_service_ipki selenium-node-firefox-rc.yamla tényleges Selenium hub szolgáltatás IP-címét, ebben az esetben a 10.254.124.73.

[root@kube-master ~]# kubectl create -f selenium-node-firefox-rc.yaml

replicationcontrollers/selenium-node-firefox

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 2

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-firefox-lc6qt 1/1 Running 0 2m

selenium-node-firefox-y9qjp 1/1 Running 0 2m

[root@kube-master ~]# kubectl describe pod selenium-node-firefox-lc6qt

Name: selenium-node-firefox-lc6qt

Namespace: default

Image(s): selenium/node-firefox

Node: kube-node2/45.63.16.92

Labels: name=selenium-node-firefox

Status: Running

Reason:

Message:

IP: 10.20.101.3

Replication Controllers: selenium-node-firefox (2/2 replicas created)

Containers:

selenium-node-firefox:

Image: selenium/node-firefox

State: Running

Started: Sat, 24 Oct 2015 17:08:37 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {scheduler } scheduled Successfully assigned selenium-node-firefox-lc6qt to kube-node2

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD pulled Pod container image "gcr.io/google_containers/pause:0.8.0" already present on machine

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD created Created with docker id cdcb027c6548

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD started Started with docker id cdcb027c6548

Sat, 24 Oct 2015 17:08:36 +0000 Sat, 24 Oct 2015 17:08:36 +0000 1 {kubelet kube-node2} spec.containers pulled Successfully pulled image "selenium/node-firefox"

Sat, 24 Oct 2015 17:08:36 +0000 Sat, 24 Oct 2015 17:08:36 +0000 1 {kubelet kube-node2} spec.containers created Created with docker id 8931b7f7a818

Sat, 24 Oct 2015 17:08:37 +0000 Sat, 24 Oct 2015 17:08:37 +0000 1 {kubelet kube-node2} spec.containers started Started with docker id 8931b7f7a818

[root@kube-master ~]# kubectl describe pod selenium-node-firefox-y9qjp

Name: selenium-node-firefox-y9qjp

Namespace: default

Image(s): selenium/node-firefox

Node: kube-node1/185.92.221.67

Labels: name=selenium-node-firefox

Status: Running

Reason:

Message:

IP: 10.20.92.3

Replication Controllers: selenium-node-firefox (2/2 replicas created)

Containers:

selenium-node-firefox:

Image: selenium/node-firefox

State: Running

Started: Sat, 24 Oct 2015 17:08:13 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {scheduler } scheduled Successfully assigned selenium-node-firefox-y9qjp to kube-node1

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD pulled Pod container image "gcr.io/google_containers/pause:0.8.0" already present on machine

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD created Created with docker id ea272dd36bd5

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD started Started with docker id ea272dd36bd5

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} spec.containers created Created with docker id 6edbd6b9861d

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} spec.containers started Started with docker id 6edbd6b9861d

Amint látjuk, a Kubernetes 2 replikát hozott létre, selenium-firefox-nodeés szétosztotta a fürtben. A pod selenium-node-firefox-lc6qta kube-node2-n, míg a pod selenium-node-firefox-y9qjpa kube-node1-en van.

Ugyanezt a folyamatot megismételjük a szelén Chrome-csomópontjainkkal.

Chrome csomópont-replikációs vezérlő:

# selenium-node-chrome-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-node-chrome

labels:

app: selenium-node-chrome

spec:

replicas: 2

selector:

app: selenium-node-chrome

template:

metadata:

labels:

app: selenium-node-chrome

spec:

containers:

- name: selenium-node-chrome

image: selenium/node-chrome

ports:

- containerPort: 5900

env:

- name: HUB_PORT_4444_TCP_ADDR

value: "replace_with_service_ip"

- name: HUB_PORT_4444_TCP_PORT

value: "4444"

Telepítés:

[root@kube-master ~]# kubectl create -f selenium-node-chrome-rc.yaml

replicationcontrollers/selenium-node-chrome

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-chrome selenium-node-chrome selenium/node-chrome app=selenium-node-chrome 2

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 2

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-chrome-9u1ld 1/1 Running 0 1m

selenium-node-chrome-mgi52 1/1 Running 0 1m

selenium-node-firefox-lc6qt 1/1 Running 0 11m

selenium-node-firefox-y9qjp 1/1 Running 0 11m

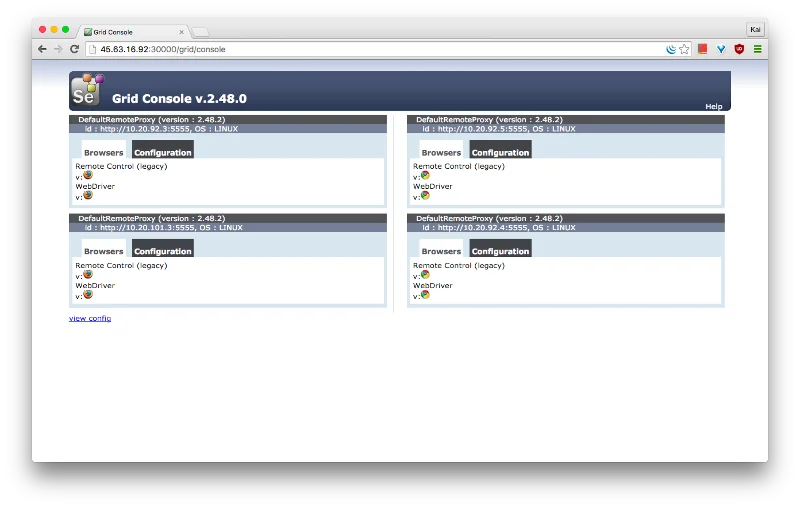

Becsomagolás

Ebben az útmutatóban egy 3 szerverből álló kis Kubernetes-fürtöt állítottunk be (1 fővezérlő + 2 dolgozó).

Pod-ok, RC-k és egy szolgáltatás segítségével sikeresen telepítettünk egy központi hubból és 4 csomópontból álló Selenium Grid-et, amely lehetővé teszi a fejlesztők számára, hogy egyszerre 4 szeléntesztet tudjanak futtatni a fürtön.

A Kubernetes automatikusan ütemezte a tárolókat a teljes fürtben.

![A Kubernetes használatának első lépései a CentOS 7 rendszeren A Kubernetes használatának első lépései a CentOS 7 rendszeren]()

Öngyógyítás

Ha egy vagy több szerverünk leáll, a Kubernetes automatikusan átütemezi a podokat az egészséges szerverekre. Példámban a kube-node2 jelenleg a Selenium hub pod és 1 Selenium Firefox csomópont pod fut.

[root@kube-node2 ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

5617399f146c selenium/node-firefox "/opt/bin/entry_poin 5 minutes ago Up 5 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-zmj1r_default_31c89517-7a75-11e5-8648-5600001611e0_baae8e00

185230a3b431 gcr.io/google_containers/pause:0.8.0 "/pause" 5 minutes ago Up 5 minutes k8s_POD.3805e8b7_selenium-node-firefox-zmj1r_default_31c89517-7a75-11e5-8648-5600001611e0_40f809df

fdd5834c249d selenium/hub "/opt/bin/entry_poin About an hour ago Up About an hour k8s_selenium-hub.cb8bf0ed_selenium-hub-pilc8_default_6c98c1ff-7a68-11e5-8648-5600001611e0_5765e2c9

00e4ccb0bda8 gcr.io/google_containers/pause:0.8.0 "/pause" About an hour ago Up About an hour k8s_POD.3b3ee8b9_selenium-hub-pilc8_default_6c98c1ff-7a68-11e5-8648-5600001611e0_8398ac33

A szerver meghibásodását a kube-node2 leállításával szimuláljuk. Néhány perc múlva látnia kell, hogy a kube-node2-n futó konténereket átütemezték a kube-node1-re, biztosítva a szolgáltatás minimális fennakadását.

[root@kube-node1 ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

5bad5f582698 selenium/hub "/opt/bin/entry_poin 19 minutes ago Up 19 minutes k8s_selenium-hub.cb8bf0ed_selenium-hub-hycf2_default_fe9057cf-7a76-11e5-8648-5600001611e0_ccaad50a

dd1565a94919 selenium/node-firefox "/opt/bin/entry_poin 20 minutes ago Up 20 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-g28z5_default_fe932673-7a76-11e5-8648-5600001611e0_fc79f977

2be1a316aa47 gcr.io/google_containers/pause:0.8.0 "/pause" 20 minutes ago Up 20 minutes k8s_POD.3805e8b7_selenium-node-firefox-g28z5_default_fe932673-7a76-11e5-8648-5600001611e0_dc204ad2

da75a0242a9e gcr.io/google_containers/pause:0.8.0 "/pause" 20 minutes ago Up 20 minutes k8s_POD.3b3ee8b9_selenium-hub-hycf2_default_fe9057cf-7a76-11e5-8648-5600001611e0_1b10c0e7

c611b68330de selenium/node-firefox "/opt/bin/entry_poin 33 minutes ago Up 33 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-8ylo2_default_31c8a8f3-7a75-11e5-8648-5600001611e0_922af821

828031da6b3c gcr.io/google_containers/pause:0.8.0 "/pause" 33 minutes ago Up 33 minutes k8s_POD.3805e8b7_selenium-node-firefox-8ylo2_default_31c8a8f3-7a75-11e5-8648-5600001611e0_289cd555

caf4e725512e selenium/node-chrome "/opt/bin/entry_poin 46 minutes ago Up 46 minutes k8s_selenium-node-chrome.362a34ee_selenium-node-chrome-mgi52_default_392a2647-7a73-11e5-8648-5600001611e0_3c6e855a

409a20770787 selenium/node-chrome "/opt/bin/entry_poin 46 minutes ago Up 46 minutes k8s_selenium-node-chrome.362a34ee_selenium-node-chrome-9u1ld_default_392a15a4-7a73-11e5-8648-5600001611e0_ac3f0191

7e2d942422a5 gcr.io/google_containers/pause:0.8.0 "/pause" 47 minutes ago Up 47 minutes k8s_POD.3805e8b7_selenium-node-chrome-9u1ld_default_392a15a4-7a73-11e5-8648-5600001611e0_f5858b73

a3a65ea99a99 gcr.io/google_containers/pause:0.8.0 "/pause" 47 minutes ago Up 47 minutes k8s_POD.3805e8b7_selenium-node-chrome-mgi52_default_392a2647-7a73-11e5-8648-5600001611e0_20a70ab6

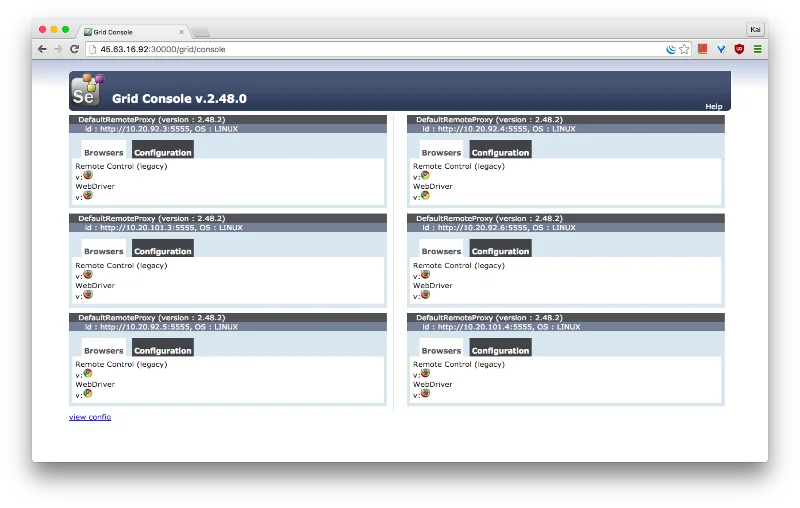

A szelénrács méretezése

A Selenium Grid méretezése rendkívül egyszerű a Kubernetes segítségével. Képzeld el, hogy 2 Firefox csomópont helyett 4-et szeretnék futtatni. A felskálázás egyetlen paranccsal elvégezhető:

[root@kube-master ~]# kubectl scale rc selenium-node-firefox --replicas=4

scaled

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-chrome selenium-node-chrome selenium/node-chrome app=selenium-node-chrome 2

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 4

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-chrome-9u1ld 1/1 Running 0 14m

selenium-node-chrome-mgi52 1/1 Running 0 14m

selenium-node-firefox-8ylo2 1/1 Running 0 40s

selenium-node-firefox-lc6qt 1/1 Running 0 24m

selenium-node-firefox-y9qjp 1/1 Running 0 24m

selenium-node-firefox-zmj1r 1/1 Running 0 40s

![A Kubernetes használatának első lépései a CentOS 7 rendszeren A Kubernetes használatának első lépései a CentOS 7 rendszeren]()

(egy másik Kubernetes csomópont nyilvános IP-címét használva)

(egy másik Kubernetes csomópont nyilvános IP-címét használva)