How to Download and Update Dell Latitude 5420 Drivers for Windows

Apreneu com descarregar i actualitzar els controladors de Dell Latitude 5420 a Windows per a un rendiment optimitzat i una operació sense problemes.

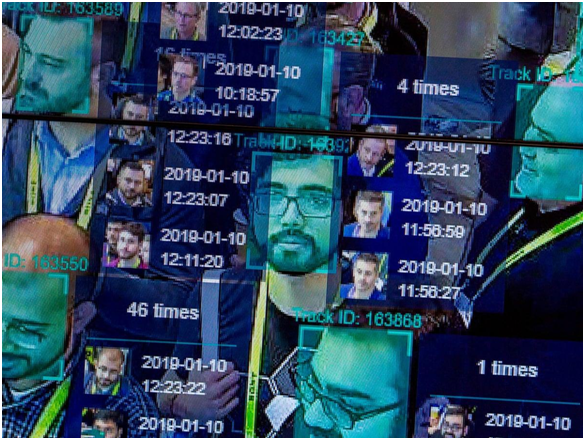

La tecnologia de reconeixement facial i les seves habilitats han crescut molt més enllà de la nostra imaginació des que els nous algorismes per reforçar aquesta tecnologia en l'aplicació de la llei han cobrat protagonisme. Actualment, les forces de seguretat utilitzen la tecnologia de reconeixement facial als nivells més baixos dels processos de recollida de dades per identificar delinqüents enmig de reunions multitudinàries. La tecnologia utilitza imatges de càmeres de CCTV a llocs públics i carrers i després executa les dades recopilades contra els arxius de l'agència per detectar una cara que es busca per delictes penals.

Aquesta tecnologia s'ha incorporat encara més als gadgets més petits, inclosos els telèfons mòbils i els dispositius portàtils intel·ligents. Per tant, no només us protegeix als carrers, sinó que també té la intenció de protegir la vostra informació personal emmagatzemada als vostres dispositius intel·ligents. L'ús de la "impressió facial" per a pràctiques de màrqueting i publicitat s'ha convertit en comú a l'era moderna de les campanyes a les xarxes socials. I després, hi ha vigilància privada en centres comercials, botigues, etc.

Des d'aquesta perspectiva, es poden assenyalar ràpidament els avantatges innegables de la tecnologia de reconeixement facial. Però també ha estat examinat per l'amenaça que suposa per a la privadesa dels usuaris, la protecció de dades i, per descomptat, la transparència entre la llei i el públic. És bo tenir en compte tant els avantatges com els inconvenients d'una tecnologia tan invasiva. No obstant això, hi ha un desavantatge més de la tecnologia de reconeixement facial, que la gent sembla ignorar, i és el perfil racial i la discriminació racial .

En aquesta peça, observem com aquesta tecnologia promou els prejudicis i la discriminació racial i com de greus són les repercussions d'aquesta tecnologia invasiva.

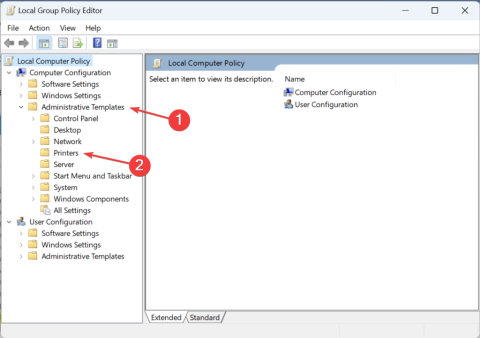

Com funciona el reconeixement facial?

Font de la imatge: National Post

Pas 1: es fa una foto teva des d'una càmera, el teu compte, el correu electrònic, etc. És una foto de perfil directa o una instantània aleatòria en una multitud.

Pas 2: el programari de reconeixement facial us executarà a través d'una base de dades d'empremtes facials emmagatzemades. L'empremta facial es recull mitjançant un seguiment geomètric de la cara.

Pas 3: es produeix un percentatge de coincidència de la vostra imatge amb qualsevol empremta facial coneguda mitjançant un algorisme sobre el qual es fa una determinació.

Biaix d'automatització: un dels molts defectes de la tecnologia de reconeixement facial

Automation Bias o Machine Bias es refereix a l'escenari en què un algorisme de màquina presenta un cert biaix en el calibratge de les dades d'entrada, donant així una sortida desfavorable. Això passa quan hi ha un error en el codi de l'algorisme, la manca de conjunts de dades emmagatzemats per al calibratge, els valors d'entrada incorrectes o les dades d'entrada excessives, que superen la capacitat de calibració de les màquines.

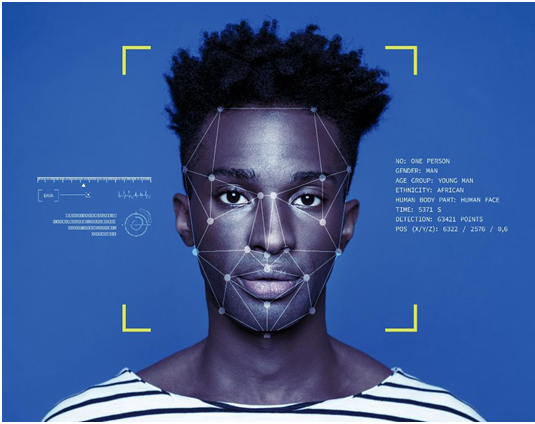

Com va el perfil racial amb tot això?

Font de la imatge: The Guardian

Comencem amb un incident antic que en aquell moment es considerava insignificant. El 2001, Tampa City va utilitzar un programari de reconeixement facial per a la vigilància de la ciutat plena de gent mentre els turistes inundaven els carrers de la ciutat a causa del Super Bowl del 2001. Segons un informe del New York Times , el programari va identificar 19 persones que suposadament tenien ordres pendents contra elles; tanmateix, no es van fer detencions ja que la infraestructura de l'estadi va fer impossible arribar als culpables identificats entre una multitud aclaparadora.

Tot i que els signes del perfil racial no es van veure enlloc en aquest cas concret, va ser la primera vegada que es van posar en pràctica tècniques de vigilància contra la violació de les llibertats civils i la privadesa de les persones. En els propers anys, la policia de Tampa va renunciar a aquests sistemes de vigilància citant resultats poc fiables.

Font de la imatge: ICO

Avançant ràpidament a un escenari una mica més recent, Ali Breland va informar per a The Guardian , sobre la detenció de Willie Lynch, un home negre acusat de ser un famós traficant de drogues a la zona de Brentwood, predominantment un barri de gent de color. L'única prova contra Lynch eren les seves imatges en un mòbil, que es van executar contra una base de dades policial abans que la policia el definís com a culpable. Lynch va ser condemnat durant vuit anys, que ara ha apel·lat contra la condemna. Tant si era el suposat distribuïdor com si no, inevitablement suscita la preocupació sobre si només un resultat basat en una màquina és suficient per mantenir la condemna de qualsevol persona investigada?

L'any 2019, segons va informar Tom Perkins per a The Guardian , es va trobar que la policia de Detroit utilitzava el reconeixement facial per fer arrests suposadament durant els últims dos anys. Detroit és un lloc on més del 80% de la població és negra. Una declaració d'un membre negre de la Comissió de Policia de Detroit va plantejar preocupacions contra la pràctica. Va dir que els negres tenen un tret facial comú que posa en perill l'algoritme del sistema, anomenant-ho "tecnoracisme".

Font de la imatge: Vox

En una investigació del 2019 per al Journal of Information Communication and Ethics Society, realitzada per Fabio Bacchini i Ludovica Lorusso, es va trobar que aquests sistemes biomètrics i de reconeixement facial no són 100% fiables per a les forces de l'ordre. A més, la discriminació racial va tenir un impacte negatiu en tots aquests sistemes, la qual cosa té més implicacions socials inverses. L'estudi es va dirigir en particular a les societats occidentals, on aquests sistemes s'utilitzen àmpliament per a la vigilància.

Aquests són només tres dels molts exemples en què han sortit a la llum casos de disparitats racials causades pels sistemes de reconeixement facial. Però, per què aquests sistemes són tan incompetents malgrat la creixent precisió en les actualitzacions de codificació algorítmica de la tecnologia.

La supremacia blanca als Estats occidentals: una indústria tecnològica dominant en blanc

El 2014, es va trobar que la majoria d'empreses tecnològiques, inclosa el gegant Apple Inc., contractaven majoritàriament empleats masculins blancs. A Apple, el 55% dels empleats eren blancs, i de la mateixa manera, el lideratge d'Apple comprenia el 63% dels empleats blancs. Les empreses que van compartir informes de diversitat similars també inclouen Facebook , Google i Twitter. Cinc anys més tard, un informe a Wired va revelar que hi havia hagut una millora mínima en aquests números.

Tot i que Facebook va mostrar una millora decent en les xifres, el percentatge de treballadors tècnics negres d'Apple es va mantenir sense canvis en només un 6% de la força de treball total. Amazon va ser l'única organització que va registrar un 42% de treballadors negres o llatinoamericans a les seves oficines dels Estats Units.

Què signifiquen aquestes estadístiques? Als EUA, la majoria dels codificadors, que estan assignats a grans projectes com el disseny d'algoritmes per a sistemes de vigilància, són blancs. Són les persones que prenen les decisions més significatives pel que fa a un producte o servei que una empresa ha de llançar/desvetllar. I, per tant, són les seves perspectives, enfocament i processos de pensament els que van a la creació final. Això no vol dir que els blancs siguin racistes i que hagin dissenyat a propòsit aquests sistemes de vigilància . NO!

Font de la imatge: Forbes

Quan un noi blanc dissenya un algorisme de reconeixement facial i només té col·legues blancs que el consultin o l'ajudin, no tenen en compte els trets facials d'un altre color abans de finalitzar el codi. Com que els enginyers blancs dominen la indústria tecnològica, els arxius de dades utilitzats per preparar el codi inicial també són creats i calibrats per tècnics blancs. Així, el codi en si es crea amb un biaix en el seu algorisme de càlcul bàsic, donant lloc a aquestes disparitats racials en els resultats de la vigilància.

El codi simplement aprèn què encarnen els blancs. No hi ha perspectiva ni aportació de cap persona d'un altre color.

Problemes de calibració

Les forces de l'ordre nord-americanes depenen molt de la vigilància i el seguiment de dades. Hi ha hagut molts casos en què els denunciants van expulsar informació sobre la vigilància no autoritzada de civils. La revelació d'Edward Snowden de la vigilància il·legal de la NSA n'és un exemple.

Font de la imatge: CBS Local

Aquests programes de vigilància estan recolzats per empremtes facials i altra informació personal de milions de ciutadans. Si només tenim en compte les empremtes facials, hi ha milions de nord-americans que comparteixen imatges obertament a les plataformes de xarxes socials. Després hi ha càmeres de CCTV a tots els carrers del país que ofereixen imatges en directe de centenars de milers de transeünts. Actualment, hi ha aproximadament 117 milions d'imatges a les bases de dades de la policia, mentre que l'FBI té més de 400 milions de conjunts de dades per calibrar en algorismes de reconeixement facial de vigilància.

Ara imagineu aquests conjunts de dades comparats amb una única imatge que pot haver capturat o no tots els trets facials d'una persona en particular. En aquest escenari, és probable que es produeixin errors. Hi ha massa dades per comprendre i executar-les en una sola empremta. Cap algorisme pot garantir el cent per cent de seguretat en el seu resultat quan el calibratge és tan complicat. Això finalment s'afegeix al perfil racial causat per la tecnologia de reconeixement facial.

La immensa fiabilitat en el reconeixement facial

Font de la imatge: NY Post

El cas de Willie Lynch és un recordatori que el reconeixement facial no hauria de ser l'única tècnica fiable presentada com a prova quan es tracta de fer complir la llei. Aquesta és la raó per la qual la policia de la ciutat de Tampa va renunciar a la tecnologia.

És cert que el reconeixement facial és un excel·lent recurs i és útil per a la policia. Els culpables dels bombardejos de la Marató de Boston van ser reconeguts mitjançant una anàlisi exhaustiva i detallada dels enregistraments de vigilància. Però aquesta no pot ser l'evidència singular per condemnar ningú. Hi ha d'haver evidència de suport per demostrar els resultats dels algorismes de reconeixement facial, i el concepte de biaix d'automatització s'ha de considerar abans d'arribar a una determinació final.

El problema del maquinari: reconeixement facial en mòbils i càmeres

Font de la imatge: TechCrunch

Els sistemes de càmeres de vigilància i el maquinari i el programari associats no estan dissenyats per una sola empresa. És una indústria que val milers de milions de dòlars en què desenes de corporacions competeixen per obtenir contractes de les agències d'aplicació de la llei. Molts d'aquests sistemes són de fabricants xinesos. Es tracta d'aconseguir la tecnologia més barata amb les millors qualitats. Així és com funciona sobretot. I per tant, sempre hi ha possibilitats de diferències en el calibratge dels diferents sistemes, així com variacions en la qualitat dels resultats de la vigilància. Molts algorismes de vigilància amb càmeres són ineficaços per calibrar imatges de persones de color només per incompetència tècnica, glorificant així la discriminació racial.

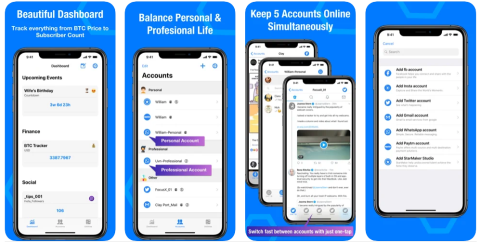

Els problemes tecnològics que causen racisme mitjançant el reconeixement facial també s'han observat a la funció de bloqueig facial d'Apple. Un cas de la Xina va eliminar que el bloqueig facial de l'iPhone X no va poder diferenciar entre dos companys de feina xinesos diferents, fent que la funció fos inútil. Es van descartar informes similars, citant problemes en la funció per separar dues persones negres entre si. Com s'ha dit anteriorment, Apple només té un 6% de persones negres en equips tècnics. És un exemple clar de com una tecnologia de reconeixement facial pot promoure el racisme fins i tot als nostres dispositius portàtils.

Conclusió

Sí, el reconeixement facial és racista, i això és de coneixement comú ara. Tot i que la tecnologia creix diàriament per solucionar aquests problemes, els resultats són tots els mateixos. Se suposa que la tecnologia uneix el món per objectius comuns d'avenços tècnics i desenvolupament, però algunes tècniques només estan causant danys a l'harmonia racial i comunitària.

De moment, el millor que poden fer els funcionaris de la llei és no donar suport als seus casos basant-se en proves de calibracions algorítmiques, que ni tan sols són fiables. A més, ja és hora que es prengui seriosament la diversitat i la inclusió en els llocs de treball perquè persones de totes les ètnies es puguin unir per crear un producte lliure de disparitats racials. Hi ha milers de races al món i la gent ha crescut per deixar de banda les diferències racials, que han perseguit la societat global durant tant de temps. Si això s'ha de mantenir, les màquines en les quals confiem tant s'han d'ensenyar igual.

Apreneu com descarregar i actualitzar els controladors de Dell Latitude 5420 a Windows per a un rendiment optimitzat i una operació sense problemes.

Apreneu a utilitzar Google Sheets, l

Are you facing difficulty playing Jade Empire special edition on your Windows PC? Read the blog to find out how to fix Jade Empire Special Edition Failed to find Steam on Windows 10.

Google Find My Device no funciona? No us preocupeu, el blog us proporcionarà una guia completa per resoldre problemes i resoldre problemes de Google Find My Device.

Exploreu solucions pas a pas adaptades als sistemes Mac, garantint una experiència de Discord perfecta sense interrupcions.

Apreneu a clonar qualsevol aplicació d'iPhone sense fer jailbreak al vostre dispositiu. Exploreu els millors cloners d'aplicacions per a iPhone per crear còpies d'aplicacions i canviar de compte fàcilment.

Exploreu els passos de resolució de problemes per resoldre problemes habituals i recupereu la reproducció de Netflix a Roku sense problemes.

Saps com veure totes les aplicacions que et segueixen a Facebook? I tens alguna idea de com bloquejar-los? Continueu llegint per trobar com protegir les vostres dades de les aplicacions rastrejades per Facebook.

Obteniu més informació sobre el mode d'impressió protegit de Windows i les instruccions pas a pas per activar-lo, millorant la seguretat i la qualitat d'impressió.

: Exploreu mètodes de resolució de problemes per resoldre l'error de memòria de referència La instrucció a 0x00 i garantir una experiència informàtica estable i sense errors.