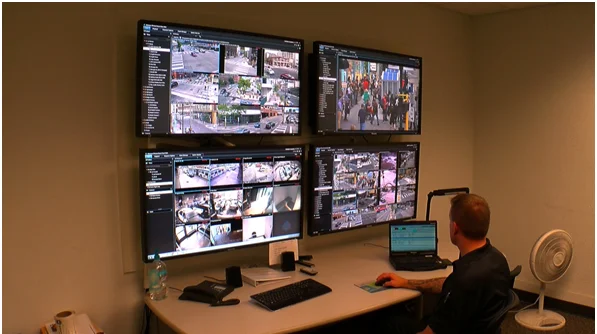

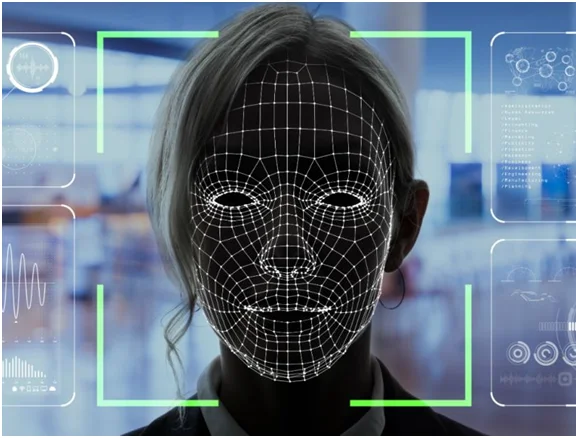

Технологія розпізнавання обличчя та її можливості виросли далеко за межі нашої уяви з тих пір, як нові алгоритми для посилення цієї технології в правоохоронних органах стали відомими. Наразі технологія розпізнавання облич використовується правоохоронними органами на найнижчих рівнях процесів збору даних для виявлення злочинців серед масових зібрань. Технологія використовує кадри з камер відеоспостереження в громадських місцях і вулицях, а потім використовує зібрані дані в архівах агентства, щоб виявити обличчя, яке розшукується за кримінальні злочини.

Ця технологія також була вбудована в найменші гаджети, включаючи мобільні телефони та розумні носимі пристрої. Таким чином, він не лише захищає вас на вулицях, а й має намір захистити вашу особисту інформацію, що зберігається на ваших розумних пристроях. Використання «відбитка обличчя» для маркетингових та рекламних практик стало звичним у сучасну епоху кампаній у соціальних мережах. А потім — приватне спостереження в торгових центрах, роздрібних магазинах тощо.

З цієї точки зору можна швидко вказати на незаперечні переваги технології розпізнавання обличчя. Але він також був ретельно перевірений на предмет загрози, яку він становить для конфіденційності користувачів, захисту даних і, звичайно, прозорості між законом і громадськістю. Добре знати як переваги, так і недоліки такої інвазивної технології. Проте є ще один недолік технології розпізнавання облич, який люди, здається, ігнорують, а це расове профілювання та расова дискримінація .

У цій статті ми розглянемо, як ця технологія сприяє расовій упередженості та дискримінації, і наскільки серйозними є наслідки такої інвазивної технології.

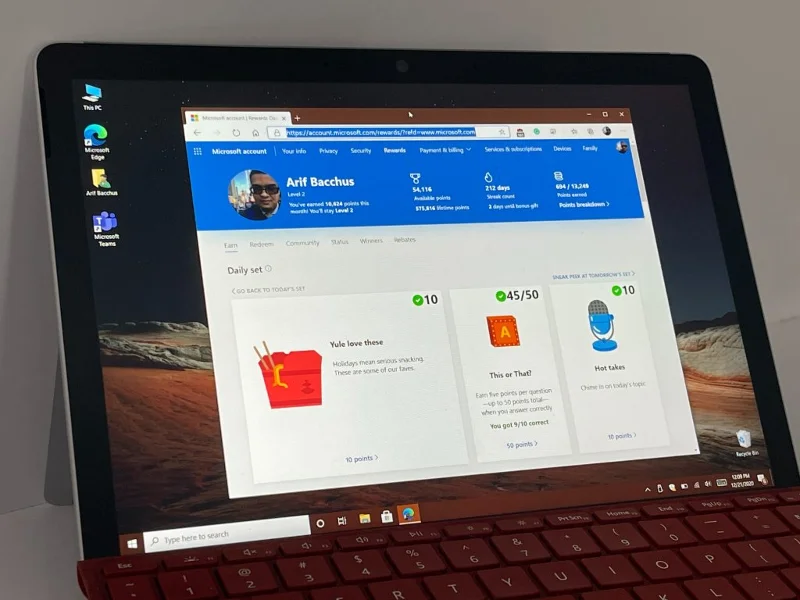

Як працює розпізнавання облич?

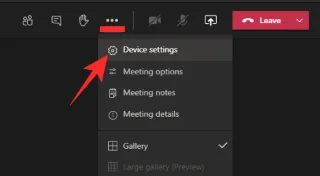

Джерело зображення: National Post

Крок 1. Ваше зображення зроблено з камери, вашого облікового запису, електронної пошти тощо. Це або пряме зображення профілю, або випадковий знімок у натовпі.

Крок 2: Програмне забезпечення для розпізнавання обличчя запустить ваше обличчя через базу даних збережених відбитків обличчя. Відбиток обличчя збирається за допомогою геометричного відстеження вашого обличчя.

Крок 3. Відсоток збігу вашого зображення з будь-яким відомим відбитком обличчя створюється за допомогою алгоритму, за яким здійснюється визначення.

Упередження автоматизації: один з багатьох недоліків технології розпізнавання обличчя

Зміщення автоматизації або зміщення машини відноситься до сценарію, коли машинний алгоритм демонструє певне зміщення в калібруванні вхідних даних, таким чином дає несприятливий вихід. Це відбувається, коли є помилка в коді алгоритму, відсутність збережених наборів даних для калібрування, неправильні вхідні значення або надмірні вхідні дані, які не під силу калібрувати машин.

Як расове профілювання поєднується з усім цим?

![Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським? Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським?]()

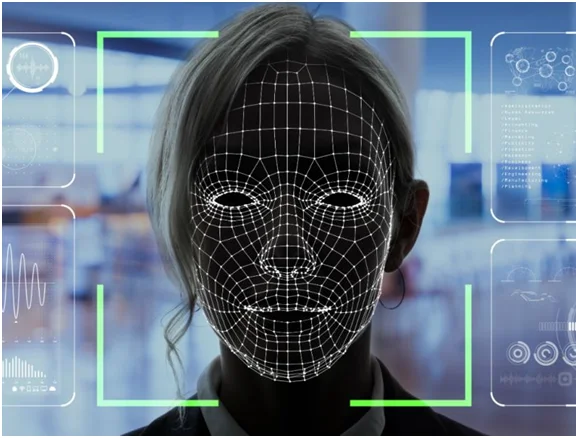

Джерело зображення: The Guardian

Почнемо з давнього випадку, який на той час вважався незначним. У 2001 році Тампа-Сіті використовував програмне забезпечення для розпізнавання облич для спостереження за переповненим містом, коли туристи заполонили вулиці міста через Суперкубок 2001 року. Згідно зі звітом New York Times , програмне забезпечення виявило 19 осіб, які імовірно мали непогашені ордери проти них; однак жодних арештів не було, оскільки інфраструктура стадіону унеможливила потрапити до виявлених винних серед величезної юрби.

Хоча ознаки расового профілювання ніде не було помічено в цьому конкретному випадку, це був перший випадок, коли методи спостереження були застосовані проти порушення громадянських свобод і приватного життя людей. У наступні роки поліція Тампи відмовилася від цих систем спостереження, посилаючись на ненадійні результати.

Джерело зображення: ICO

Переходячи до дещо пізнішого сценарію, Алі Бреланд повідомив для The Guardian про арешт Віллі Лінча, чорношкірого чоловіка, якого звинувачують у тому, що він був горезвісним торговцем наркотиками в районі Брентвуда, переважно в кварталі кольорових людей. Єдиним доказом проти Лінча були його фотографії на мобільному, які були перевірені в поліцейській базі даних, перш ніж поліція визначила його як винного. Лінч був засуджений на вісім років, зараз він оскаржив вирок. Незалежно від того, був він імовірним дилером чи ні, це неминуче викликає занепокоєння з приводу того, чи достатньо лише машинного результату, щоб підтвердити обвинувальний вирок будь-кому підслідним?

У 2019 році, як повідомляв Том Перкінс для The Guardian , поліція Детройта використовувала розпізнавання облич для арештів нібито протягом останніх двох років. Детройт – це місце, де понад 80% населення є чорношкірими. Заява чорношкірого члена Комісії поліції Детройта викликала занепокоєння щодо такої практики. Він сказав, що чорношкірі мають спільну рису обличчя, яка ставить під загрозу алгоритм системи, назвавши це «технорасизмом».

![Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським? Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським?]()

Джерело зображення: Vox

У дослідженні 2019 року для Journal of Information Communication and Ethics Society, проведеному Фабіо Баккіні та Людовіки Лоруссо, було виявлено, що ці біометричні системи та системи розпізнавання облич не є на 100% надійними для правоохоронних органів. Більше того, расова дискримінація негативно вплинула на всі такі системи, що має подальші зворотні соціальні наслідки. Дослідження було спрямоване, зокрема, на західні суспільства, де такі системи широко використовуються для спостереження.

Це лише три з багатьох подібних прикладів, коли виявлялися випадки расової нерівності, спричиненої системами розпізнавання облич. Але чому ці системи такі некомпетентні, незважаючи на таку зростаючу точність у модернізації алгоритмічного кодування в технології.

Перевага білого в західних штатах: технологічна галузь з домінуванням білого

У 2014 році було виявлено, що більшість технологічних компаній, включаючи гігант Apple Inc., наймають переважно білих чоловіків. В Apple 55% співробітників були білими, а також керівництво Apple складало 63% білих співробітників. Серед компаній, які поділилися подібними звітами про різноманітність, також були Facebook , Google і Twitter. Через п’ять років у звіті Wired було виявлено мінімальне покращення цих цифр.

Хоча Facebook продемонстрував пристойне покращення чисельності, відсоток чорношкірих технічних працівників Apple залишився незмінним і становив лише 6% від загальної робочої сили. Amazon була єдиною організацією, яка зареєструвала 42% чорношкірих або латиноамериканських працівників у своїх офісах у США.

Що означає ця статистика? У США більшість кодерів, яких призначають для великих проектів, таких як розробка алгоритмів для систем спостереження, білі. Це люди, які приймають найважливіші рішення щодо продукту чи послуги, які мають бути запущені/представлені компанією. А отже, саме їхні перспективи, підхід та процеси мислення входять до остаточного створення. Це не означає, що білі люди є расистами і спеціально створили такі системи спостереження . НЕМАЄ!

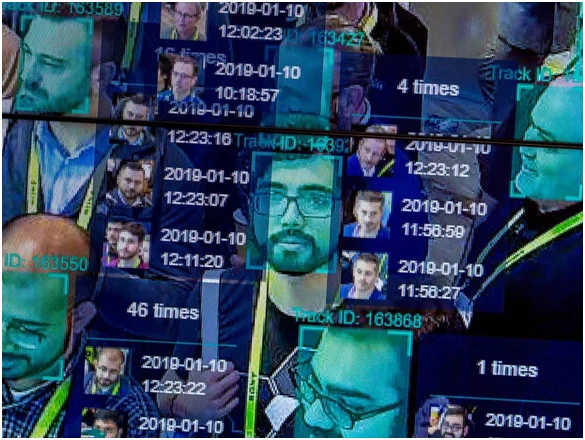

![Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським? Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським?]()

Джерело зображення: Forbes

Коли білий хлопець розробляє алгоритм розпізнавання обличчя і має лише білих колег, які консультують/допомагають йому, вони не розглядають риси обличчя людей іншого кольору, перш ніж завершити код. Оскільки білі інженери домінують у технологічній галузі, архіви даних, які використовуються для підготовки початкового коду, також створюються та калібруються білими техніками. Таким чином, сам код створюється з упередженням у своєму основному алгоритмі обчислень, що призводить до цих расових відмінностей у результатах спостереження.

Код просто дізнається, що в ньому втілюють білі люди. Немає жодної точки зору чи внеску будь-якої людини іншого кольору.

Питання калібрування

Американські правоохоронні органи в значній мірі покладаються на спостереження та відстеження даних. Було багато випадків, коли викривачі викривали інформацію про несанкціоноване спостереження за цивільними особами. Одним із таких прикладів є розкриття Едвардом Сноуденом незаконного стеження АНБ.

![Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським? Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським?]()

Джерело зображення: CBS Local

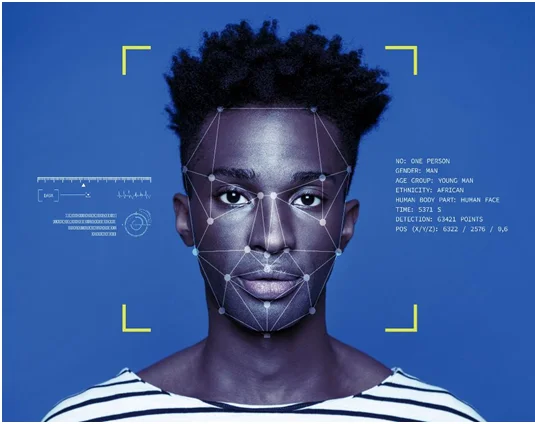

Ці програми спостереження підтримуються відбитками обличчя та іншою особистою інформацією мільйонів громадян. Якщо розглядати лише відбитки обличчя, то мільйони американців відкрито діляться фотографіями в соціальних мережах. Крім того, на кожній вулиці країни є камери відеоспостереження, які показують живі кадри сотень тисяч перехожих. Наразі в поліцейських базах даних налічується приблизно 117 мільйонів зображень, тоді як ФБР має понад 400 мільйонів наборів даних для калібрування в алгоритмах розпізнавання осіб для спостереження.

А тепер уявіть собі ці набори даних у порівнянні з одним зображенням, яке, можливо, відобразило всі риси обличчя конкретної людини. У такому випадку можуть виникнути помилки. Просто забагато даних, щоб їх зрозуміти та запустити на одному відбитку обличчя. Жоден алгоритм не може гарантувати стовідсоткову впевненість у своєму результаті, коли калібрування настільки складне. Це в кінцевому підсумку додає до расового профілювання, викликаного технологією розпізнавання обличчя.

Величезна надійність розпізнавання облич

Джерело зображення: NY Post

Справа Віллі Лінча є нагадуванням про те, що розпізнавання облич не повинно бути єдиною надійною технікою, представленою як доказ, коли справа доходить до правоохоронних органів. Ось чому поліція міста Тампа відмовилася від технології.

Це правда, що розпізнавання облич — чудовий засіб і корисний для поліції. Винуватців терактів на Бостонському марафоні було визнано за допомогою широкого та детального аналізу записів камер спостереження. Але це не може бути єдиним доказом, щоб когось засудити. Повинні бути підтверджуючі докази, щоб підтвердити результати алгоритмів розпізнавання обличчя, і концепцію упередження автоматизації необхідно розглянути до досягнення остаточного визначення.

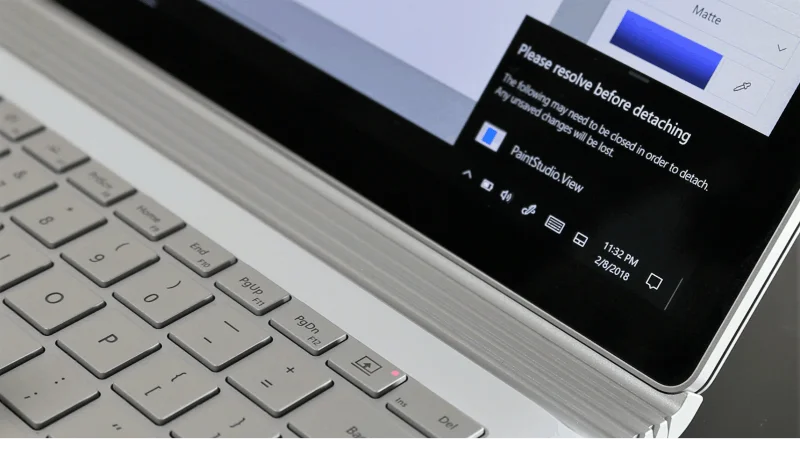

Проблеми з апаратним забезпеченням: розпізнавання облич на мобільних телефонах і камерах

![Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським? Расове профілювання в техніці розпізнавання облич: чи може розпізнавання облич бути расистським?]()

Джерело зображення: TechCrunch

Системи камер спостереження та пов’язане з ними обладнання та програмне забезпечення розроблено не однією компанією. Це галузь, що коштує мільярди доларів, у якій десятки корпорацій змагаються за контракти від правоохоронних органів. Багато з цих систем від китайських виробників. Це все в тому, щоб отримати найдешевшу техніку з найкращими якостями. Так це переважно працює. Тому завжди є ймовірність розбіжностей у калібруванні різних систем, а тако�� відмінності в якості результатів спостереження. Багато алгоритмів камер відеоспостереження неефективні для калібрування зображень кольорових людей лише через технічну некомпетентність, таким чином прославляючи расову дискримінацію.

Технологічні проблеми, які викликають расизм через розпізнавання обличчя, також були помічені у функції Apple Face Lock. Випадок з Китаю витіснив, що замок для обличчя iPhone X не зміг відрізнити двох різних китайських колег, що робить цю функцію марною. Подібні повідомлення були відхилені, посилаючись на проблеми, пов’язані з розділенням двох чорношкірих людей один від одного. Як зазначено вище, у технічних командах Apple лише 6% чорношкірих людей. Це яскравий приклад того, як технологія розпізнавання обличчя може сприяти расизму навіть у наших портативних пристроях.

Висновок

Так, розпізнавання облич є расистським, і зараз це загальновідомо. Хоча технології щодня розвиваються, щоб виправити такі проблеми, результати однакові. Передбачається, що технологія об’єднає світ заради спільних цілей технічного прогресу та розвитку, але деякі методи лише завдають шкоди расовій та суспільній гармонії.

Наразі найкраще, що можуть зробити правоохоронці, — це не підтримувати свої справи на основі доказів алгоритмічних калібрування, які навіть не є надійними. Більше того, настав час серйозно поставитися до різноманітності та залученості на робочих місцях, щоб люди всіх етнічних груп могли об’єднатися, щоб створити продукт, вільний від расових відмінностей. У світі існують тисячі рас, і люди виросли, щоб відкинути расові відмінності, які так довго переслідували глобальне суспільство. Якщо це потрібно підтримувати, то і машини, на які ми так сильно покладаємося, треба вчити тому ж.