Многи од нас су се осећали изнервирано и изопачено због искачућих прозора који се појављују када покушате да приступите сајту преко Гоогле Цхроме-а, који од вас тражи да потврдите да ли сте човек или не. Једном се чини да је најглупље питати, поготово ако вам се изнова појављује на лицу. То је ЦАПТЦХА, тест изазов-одговор који омогућава претраживачу да утврди да то није нека машина која покушава да уђе у ваше личне претраге. ЦАПТЦХА је постала уобичајена заштитна мера за спречавање нежељених робота на интернету и спречавање злоупотребе. Али последњих година, ЦАПТЦХА је проширена и такође је постала замршен задатак који захтева од нас да се концентришемо на такозвани изазов одговора. Зашто ваш претраживач од вас тражи да потврдите „Ја нисам робот“? И како се то само претворило у досадан и дуготрајан изазов? Прочитајте како је нешто што је почело као алат за уклањање спамботова, сада постало напорна трка између људи и машина.

Шта је ЦАПТЦХА?

Слика: Тхе Нев Иорк Тимес

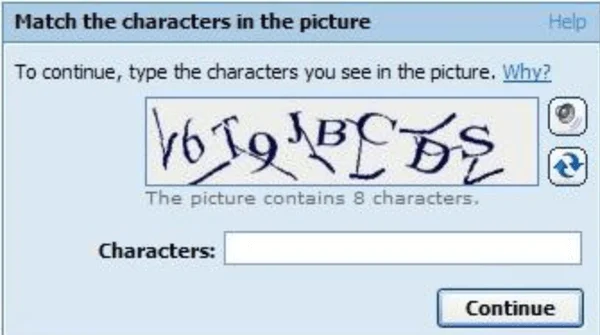

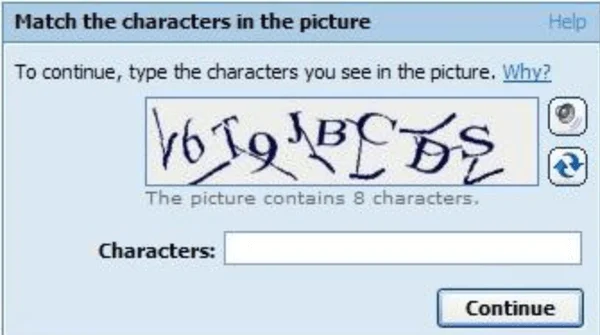

ЦАПТЦХА је скраћеница од потпуно аутоматизованог јавног Туринговог теста. Развијен је негде почетком 2000-их као тест за људе да докаже да нису машине или спам ботови који покушавају да пробију безбедност претраживача. Иако је проналазак ЦАПТЦХА-е предмет друге дебате, њена најранија верзија датира из 1997. године. Када је први пут коришћена, ЦАПТЦХА је тражила од корисника да докажу своју „хуманост” уписивањем низа искривљених слова у једноставан текст. У неким секвенцама, искривљена слова су комбинована бројевима написаним у сличном искривљеном формату. Ови знакови су написани на начин да између њих нема размака и код се мењао при сваком покушају пријављивања. Ово је учињено зато што би, да би се декодирао скоро бесконачан број изобличених секвенци, увек била потребна нека људска интелигенција; док, алгоритам рачунарске машине не може да открије искривљене секвенце. Стога су многи провајдери веб и маил услуга одмах усвојили ЦАПТЦХА.

Али онда у наредних неколико година, ЦАПТЦХА се закомпликовала.

Гоогле-ов реЦАПТЦХА: Компликована надоградња на оригинални тест

![ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ? ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ?]()

Извор слике: Бусинесс Инсидер

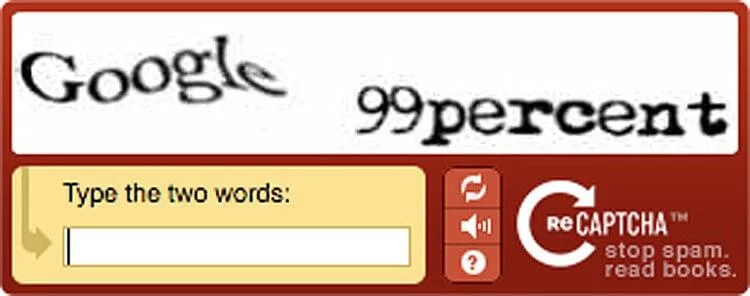

Године 2007. Гоогле је купио програм под називом реЦАПТЦХА од групе оригиналних истраживача система и почео да га интензивно користи у Гоогле Сцхолар-у и Гоогле Боокс-у. Али, одакле је и почело, ЦАПТЦХА у овом најновијем облику постала је главобоља за Гоогле кориснике. Како су истраживања о машинском учењу расла, тако је расла и способност рачунарских система и њихових алгоритама да решавају сложене проблеме. Тако су оригиналне секвенце карактера постале превише лаке за решавање ботова и машина. Дакле, Гоогле је наставио и учинио те ликове више уврнутим и технички збуњујућим за људско око. Ово је заправо покренуло праву трку између људске и машинске интелигенције, која је прешла у праву досаду која је реЦАПТЦХА постала за Гоогле кориснике. Да бисте били сигурни да корисник који приступа Гоогле платформама и претрагама није неки бот,

Додавање слика у тест: Гоогле-ова опција без ЦАПТЦХА реЦАПТЦХА

У 2014. години, доста касно након што је Гоогле купио реЦаптцха, одлучио је да реагује на неугодност коју су његове секвенце изазивале корисницима. Поред тога, током свих ових година, поново су истраживачи у циљу стварања паметнијих машина надмашили реЦАПТЦХА могућности разумевања изазова одговора. У експерименталном тесту, Гоогле истраживачи су утврдили да су, упркос крајњим компликацијама и досадним искачућим прозорима, алгоритми машинског учења успели да добију више од 99 процената тачних одговора, док смо ми људи једва успели са 33 процента. Дакле, дошло је време за промену.

![ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ? ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ?]()

Гоогле је одлучио да нестане узнемиравање корисника. Нови „НоЦАПТЦХА реЦАПТЦХА“ је омогућио корисницима да само прођу тест кликом на поље за потврду. Овог пута Гоогле је напредовао са АПИ технологијом и користио је корисничка подешавања да би одредио да ли је човек или робот. Гоогле-ов нови реЦАПТЦХА анализирао је претраге корисника, као и кретање курсора миша. Бот не може да емулира клик мишем као бот, анализирајући код за тај одређени ЦАПТЦХА тест видео би ту виртуелну квадратићу као графичку слику и не би реаговао на то. Али опет, ако бот може да чита ЈаваСцрипт, онда може лако да емулира то и опција праћења кретања миша неће успети.

Па како да решите тај проблем како треба? А шта ако сте направили другачију претрагу од ваших преференција?

![ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ? ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ?]()

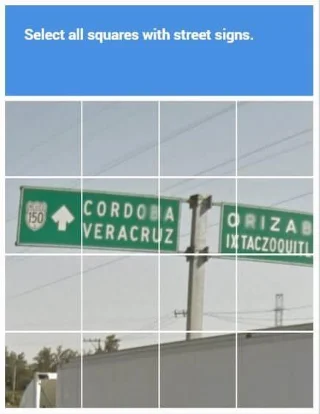

Извор слике: Реддит

Па, у том случају, добродошли на још један тест. Гоогле-ова нова реЦАПТЦХА води вас на серију „тестова ока“ да видите да ли сте човек или робот. Дакле, у случају да извршите непрепоручену или сумњиву претрагу, Гоогле би од вас тражио да одаберете неке специфичне слике из читаве групе. Сви смо приметили да нам Гоогле тражи да идентификујемо слике са семафорима, аутомобилима, парковима или путоказима, зар не? То је оно што је НоЦАПТЦХА реЦАПТЦХА.

Ово је најажурнија и најчешће коришћена верзија ЦАПТЦХА, коју не користи само Гугл, већ и платформе попут Твитера, Фацебоока и Цраигслист-а, као медиј за разликовање човека и вештачке интелигенције како би спречили нежељену пошту и злоупотребу профила корисника на друштвеним мрежама. Али још једном, слике у овој верзији постале су мутније за људске очи, повећавајући компликованост слагалице, и поново је наишла на исти пут којим је реЦАПТЦХА ишао раније.

Али зашто?

Такође прочитајте: -

Шта је сигурније? Препознавање отиска прста у односу на препознавање лица И додир отиском прста и откључавање лица постали су главне безбедносне карактеристике телефона и стално се пореде у погледу њихове ефикасности. Знај...

Зашто су ЦАПТЦХА загонетке тако компликоване?

Извор слике: Реддит

ЦАПТЦХА је покренута као медиј да спречи ботове и машине да имитирају као човека и приступају било којој врсти података на незаконит начин. Али како су истраживања и експерименти о машинском учењу и вештачкој интелигенцији отишли предалеко, па чак и били успешни, створили смо машине са способношћу да решавају много сложених прорачуна и ЦАПТЦХА је постала комад колача. Наука је дала машини тако велике способности, да би сада, ако покушамо да направимо нешто тешко за софтвер или бот, људском бићу постало теже да декодира.

Да ли је превише изненађење што ЦАПТЦХА некако не успева?

![ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ? ЦАПТЦХА: Колико дуго може остати одржива техника за разликовање човека и АИ?]()

Извор слике: Цорнер Таб Цреативе

Дефинитивно не. Направили смо функционалне квантне рачунаре. Решили смо стотине загонетки и рачунарских проблема у вези са финансијском анализом, пословним одлукама и медицинским наукама. Искористили смо тоне апликација и алата заснованих на машинама да бисмо олакшали своје животе и помогли нам у сложенијим истраживачким областима. А у међувремену, дали смо машинама сопствену интелигенцију да повећају брзину и ефикасност задатака. Пошто наши животи у великој мери зависе од вештачке интелигенције и машинског учења, било је само питање времена да ће нас надмашити.

Којом дужином ЦАПТЦХА може ићи даље?

Извор слике: Накед Сецурити

Према ономе у шта се истраживачи упуштају са овим механизмом одговора и изазова, ово је само почетак. Постојали су различити тестови за надоградњу тренутних ЦАПТЦХА алата и промену начина на који се ови тестови изазова одговора спроводе. У 2017, ПаиПал је добио патент за нову врсту ЦАПТЦХА технике. Овде би се загонетке и питања која се постављају кориснику да докаже своју људскост разликовали према њиховој етничкој припадности, локацији и полу. Слично, Амазон Тецхнологиес је патентирао ЦАПТЦХА стил слагалице, где би се од људи тражило да реше оптичке илузије и типичне логичке загонетке, које им не би биле познате. Сада, овде је Амазон покушао да преокрене загонетку. Амазон Тецхнологиес тврди да би већина људи добила такве одговоре погрешне, док би модерна вештачка интелигенција, с обзиром на своје могућности, то урадила исправно, и стога, одговор са погрешним одговором био би људски корисник. Остали патенти укључују слагалицу налик игрици за ЦАПТЦХА, где би корисници захтевали решавање врста слагалица на табли да би доказали своју хуманост. Ово су неке од почетних идеја које добијају свој пут да ажурирају ЦАПТЦХА.

Али, да ли су они заиста ефикасни?

На много начина, нису. Прво, у овој генерацији „свемирског доба“ у којој је машинско учење буквално следећи корак у људској еволуцији, ниједна ЦАПТЦХА не би остала непромењена. -Друго, ове идеје су превише компликоване за људе. Ако очекујете да момак стално тачно одговара на културолошки различита питања, онда грешите. Људи се разликују једни од других по етничкој припадности, језику и личностима у веома великом обиму и скоро је немогуће развити тако широк скуп изазова одговора на основу културног порекла. Штавише, интернет је нешто што је доступно свакоме са било ког места, без обзира на коефицијент интелигенције, године и ниво интелигенције те особе. Дакле, тешко је поверовати да би свака особа свих узраста имала у себи да реши загонетку друштвене игре како би прошла веб страницу. Вероватно, истраживачи,

Шта се може учинити да би ЦАПТЦХА била поузданија?

Па, то је предмет велике расправе и истраживања пре него што бисмо могли да смислимо нешто што би људима олакшало ово. Међутим, постоји потреба да се потражи неки аспект људског понашања који је можда немогуће да АИ бот опонаша. Више пажње се може преусмерити на развој ЦАПТЦХА алата који би тражили „акције“ на веб страници. Гоогле је недавно активирао своју верзију 3 реЦАПТЦХА под називом реЦАПТЦХА в3. Нова верзија теста одговора и изазова од стране Гоогле-а користи оно што се зове „Адаптивна анализа ризика“, која не тера кориснике на било какву врсту теста и не тражи од њих да означе виртуелну кутију. Потпуно је без трења за кориснике и омогућава им директан приступ веб страницама. Да би се извршила детекција бота ради спречавања злоупотребе нежељене поште, Гоогле-ова нова реЦАПТЦХА би омогућила власницима веб локација да утврде да ли су корисници њихових сајтова ботови или не, преко резултата које би им Гугл дао на основу свог алгоритма за анализу ризика. Резултат би открио да ли је саобраћај на сајту сумњив или не. Власници затим могу да сумњивим корисницима дају тест одговора како би проверили детекцију реЦАПТЦХА. Иако Гугл неће рећи како ће њихов нови алгоритам доделити ове резултате корисницима, може се сматрати пријатним медијумом за филтрирање саобраћаја, где су узнемираване и тешкоће корисника у решавању ранијих тестова.

Коначно мишљење

Извор слике: ВецторСтоцк

Прерано је рећи да је Гоогле-ов нови реЦАПТЦХА в3 најбољи и најприкладнији начин да се избегне промет робота на веб страницама. Штавише, темпо којим се напредују истраживања вештачке интелигенције и машинског учења, не можемо да знамо какве би импликације имале на било коју нову технику ЦАПТЦХА.

Пошто људи више улажу у машинско учење, а не у надзор над активностима машина, сви ови нови патенти ЦАПТЦХА техника могу постати неодрживи у блиској будућности. За сада, ЦАПТЦХА остаје најчешће коришћени тест одговора и изазова за откривање ботова на вебу. Али да би тако било све више и више година, важно је да се открију методе разликовања између вештачке интелигенције и људи пре него што све што имамо и шта год дефинише наше наслеђе предамо паметним машинама од којих зависимо.