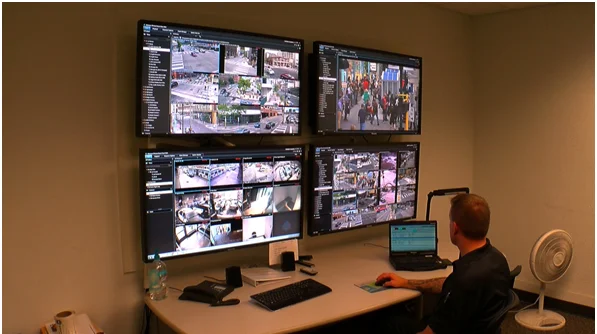

Sejas atpazīšanas tehnoloģija un tās spējas ir izaugušas tālu ārpus mūsu iztēles, kopš jauni algoritmi šīs tehnoloģijas nostiprināšanai tiesībaizsardzībā ir kļuvuši nozīmīgi. Pašlaik tiesībaizsardzības spēki izmanto sejas atpazīšanas tehnoloģiju zemākajos datu vākšanas procesu līmeņos, lai identificētu noziedzniekus pārpildītas pulcēšanās laikā. Tehnoloģija izmanto videonovērošanas kameru kadrus publiskās vietās un ielās, un pēc tam apkopo savāktos datus aģentūras arhīvos, lai noteiktu seju, kas tiek meklēta par noziedzīgiem nodarījumiem.

Šī tehnoloģija ir iestrādāta mazākajos sīkrīkos, tostarp mobilajos tālruņos un viedās valkājamās ierīcēs. Tādējādi tas ne tikai aizsargā jūs uz ielām, bet arī vēlas aizsargāt jūsu viedierīcēs saglabāto personisko informāciju. “Faceprint” izmantošana mārketinga un reklāmas praksē ir kļuvusi izplatīta mūsdienu sociālo mediju kampaņu laikmetā. Un tad ir privāta uzraudzība tirdzniecības centros, mazumtirdzniecības veikalos utt.

No šī viedokļa var ātri norādīt uz sejas atpazīšanas tehnoloģijas nenoliedzamajām priekšrocībām. Bet tas ir arī rūpīgi pārbaudīts, lai noteiktu draudus, ko tas rada lietotāju privātumam, datu aizsardzībai un, protams, pārredzamībai starp likumu un sabiedrību. Ir labi apzināties šādas invazīvas tehnoloģijas priekšrocības un trūkumus. Tomēr sejas atpazīšanas tehnoloģijai ir vēl viens trūkums, ko cilvēki, šķiet, ignorē, un tas ir rasu profilēšana un rasu diskriminācija .

Šajā rakstā mēs aplūkojam, kā šī tehnoloģija veicina rasu aizspriedumus un diskrimināciju un cik nopietnas ir šādas invazīvās tehnoloģijas sekas.

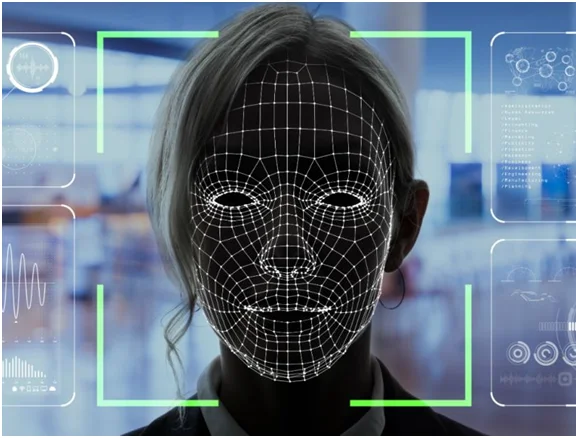

Kā darbojas sejas atpazīšana?

Attēla avots: National Post

1. darbība. Jūsu attēls tiek uzņemts no kameras, jūsu konta, e-pasta utt. Tas ir vai nu taisns profila attēls, vai arī nejaušs attēls.

2. darbība . Sejas atpazīšanas programmatūra palaidīs jūsu seju, izmantojot saglabāto sejas nospiedumu datubāzi. Sejas nospiedums tiek savākts, izmantojot jūsu sejas ģeometrisko izsekošanu.

3. darbība . Jūsu attēla atbilstības procentuālā attiecība pret jebkuru zināmo sejas nospiedumu tiek izveidota, izmantojot algoritmu, pēc kura tiek veikta noteikšana.

Automatizācijas novirze: viens no daudzajiem sejas atpazīšanas tehnikas trūkumiem

Automatizācijas novirze vai mašīnas novirze attiecas uz scenāriju, kad mašīnas algoritms ievades datu kalibrēšanā uzrāda noteiktu novirzi, tādējādi nodrošinot nelabvēlīgu izvadi. Tas notiek, ja ir kļūda algoritma kodā, nav saglabātu datu kopu kalibrēšanai, ir nepareizas ievades vērtības vai ir pārāk daudz ievades datu, kuru kalibrēšanai iekārtas nav spējīgas.

Kā rasu profilēšana ir saistīta ar to visu?

![Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska? Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska?]()

Attēla avots: The Guardian

Sāksim ar senu notikumu, kas tajā laikā tika uzskatīts par nenozīmīgu. 2001. gadā Tampa City izmantoja sejas atpazīšanas programmatūru, lai uzraudzītu pārpildīto pilsētu, jo tūristi pārpludināja pilsētas ielas 2001. gada Super Bowl dēļ. Saskaņā ar New York Times ziņojumu , programmatūra identificēja 19 cilvēkus, kuriem, domājams, bija neizpildīti orderi pret viņiem; tomēr neviens arests netika veikts, jo stadiona infrastruktūras dēļ nebija iespējams nokļūt līdz identificētajiem vainīgajiem milzīgā pūļa vidū.

Lai gan šajā konkrētajā gadījumā rasu profilēšanas pazīmes nekur nebija manītas, tā bija pirmā reize, kad novērošanas metodes tika vērstas pret personu pilsoņu brīvību un privātuma pārkāpumiem. Nākamajos gados Tampas policija atteicās no šīm novērošanas sistēmām, atsaucoties uz neuzticamiem rezultātiem.

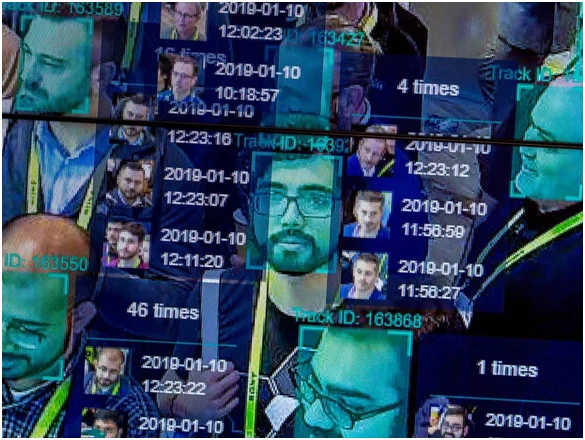

Attēla avots: ICO

Pārejot uz nedaudz jaunāku scenāriju, Ali Brelands laikrakstam The Guardian ziņoja par Villija Linča, melnādainā vīrieša, apsūdzības par bēdīgi slavenu narkotiku tirgotāju aizturēšanu Brentvudas apgabalā, kurā pārsvarā dzīvo krāsaini cilvēki. Vienīgais pierādījums pret Linču bija viņa bildes mobilajā tālrunī, kas tika pārbaudītas pret policijas datubāzi, pirms policija viņu noteica par vainīgo. Linčs tika notiesāts uz astoņiem gadiem, kurš tagad ir pārsūdzējis notiesājošo spriedumu. Neatkarīgi no tā, vai viņš bija iespējamais tirgotājs vai nē, tas neizbēgami rada bažas par to, vai tikai ar mašīnu balstītu rezultātu pietiek, lai atbalstītu jebkuras personas, par kuru tiek veikta izmeklēšana, pārliecību?

2019. gadā, kā laikrakstam The Guardian ziņoja Toms Pērkinss , Detroitas policija tika atklāta, izmantojot sejas atpazīšanu, lai veiktu arestus, iespējams, pēdējo divu gadu laikā. Detroita ir vieta, kur vairāk nekā 80% iedzīvotāju ir melnādainie. Detroitas policijas komisijas melnādainā locekļa paziņojums izraisīja bažas par šo praksi. Viņš teica, ka melnādainajiem cilvēkiem ir kopīga sejas iezīme, kas apdraud sistēmas algoritmu, nosaucot to par "tehnorasismu".

![Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska? Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska?]()

Attēla avots: Vox

2019. gada pētījumā, ko veica Fabio Bacchini un Ludovica Lorusso žurnālam Journal of Information Communication and Ethics Society, tika konstatēts, ka šīs biometriskās un sejas atpazīšanas sistēmas nav 100% uzticamas tiesībaizsardzības iestādēm. Turklāt rasu diskriminācija bija negatīva ietekme uz visām šādām sistēmām, kam ir vēl apgriezta ietekme uz sabiedrību. Pētījums bija īpaši vērsts uz rietumu sabiedrībām, kur šādas sistēmas tiek plaši izmantotas uzraudzībai.

Šie ir tikai trīs no daudziem šādiem piemēriem, kuros atklātībā nākušas rasu atšķirības, ko izraisa sejas atpazīšanas sistēmas. Bet kāpēc šīs sistēmas ir tik nekompetentas, neskatoties uz tik pieaugošo tehnoloģiju algoritmiskās kodēšanas jauninājumu precizitāti?

Balto pārākums Rietumu valstīs: baltā dominējošā tehnoloģiju nozare

2014. gadā tika konstatēts, ka lielākā daļa tehnoloģiju uzņēmumu, tostarp gigants Apple Inc., pieņem darbā galvenokārt baltās krāsas vīriešus. Apple 55% darbinieku bija baltie, un līdzīgi Apple vadībā bija 63% balto darbinieku. Uzņēmumi, kas kopīgoja līdzīgus dažādības ziņojumus, bija arī Facebook , Google un Twitter. Pēc pieciem gadiem Wired ziņojumā tika atklāts, ka šie skaitļi ir bijuši minimāli.

Kamēr Facebook uzrādīja pienācīgu skaitļu uzlabošanos, Apple melnādaino tehnisko darbinieku procentuālais daudzums nemainījās un bija tikai 6% no kopējā darbaspēka. Amazon bija vienīgā organizācija, kas savos ASV birojos reģistrēja 42% melnādaino vai Latīņamerikas strādnieku.

Ko nozīmē šī statistika? ASV lielākā daļa kodētāju, kas ir uzticēti lieliem projektiem, piemēram, novērošanas sistēmu algoritmu izstrādei, ir baltā krāsā. Tie ir cilvēki, kuri pieņem vissvarīgākos lēmumus par produktu vai pakalpojumu, ko uzņēmums laiž klajā/atklās. Līdz ar to viņu perspektīvas, pieeja un domāšanas procesi ir tie, kas nonāk galīgajā radīšanā. Tas nenozīmē, ka baltie cilvēki ir rasisti un ir apzināti izstrādājuši šādas novērošanas sistēmas . NĒ!

![Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska? Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska?]()

Attēla avots: Forbes

Kad baltais puisis izstrādā sejas atpazīšanas algoritmu un viņam konsultē/palīdz tikai baltie kolēģi, viņi pirms koda pabeigšanas neņem vērā citas krāsas sejas īpašības. Tā kā tehnoloģiju nozarē dominē baltie inženieri, datu arhīvus, ko izmanto sākotnējā koda sagatavošanai, arī izveido un kalibrē baltie tehniķi. Tādējādi pats kods tiek izveidots ar novirzi tā pamata aprēķina algoritmā, kā rezultātā rodas šīs rasu atšķirības uzraudzības rezultātos.

Kods vienkārši uzzina, ko baltie cilvēki tajā iemieso. Nav nevienas citas krāsas personas perspektīvas vai ieguldījuma.

Kalibrēšanas problēmas

Amerikas tiesībaizsardzības iestādes lielā mērā paļaujas uz novērošanu un datu izsekošanu. Ir bijuši daudzi gadījumi, kad trauksmes cēlēji izspieda informāciju par civiliedzīvotāju neatļautu novērošanu. Viens no šādiem piemēriem ir Edvarda Snoudena atklājums par NSA nelikumīgo novērošanu.

![Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska? Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska?]()

Attēla avots: CBS Local

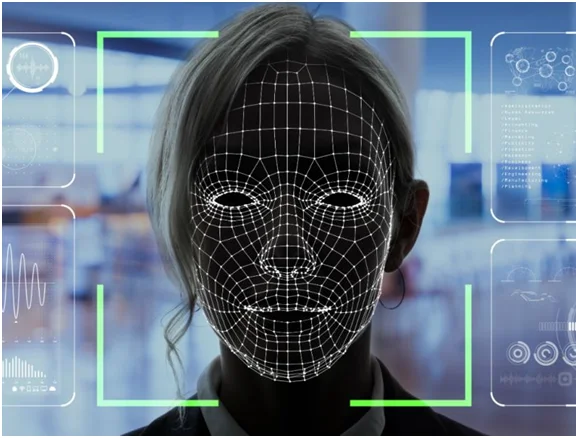

Šīs novērošanas programmas atbalsta miljoniem pilsoņu sejas nospiedumi un cita personiskā informācija. Ja ņemam vērā tikai sejas nospiedumus, miljoniem amerikāņu atklāti kopīgo attēlus sociālo mediju platformās. Tad katrā valsts ielā ir videonovērošanas kameras , kas piedāvā simtiem tūkstošu garāmgājēju tiešraides. Pašlaik policijas datubāzēs ir aptuveni 117 miljoni attēlu, savukārt FIB rīcībā ir vairāk nekā 400 miljoni datu kopu, ko kalibrēt novērošanas seju atpazīšanas algoritmos.

Tagad iedomājieties, ka šīs datu kopas tiek salīdzinātas ar vienu attēlu, kurā var būt vai nav fiksētas visas konkrētās personas sejas iezīmes. Šādā scenārijā var rasties kļūdas. Ir pārāk daudz datu, lai tos saprastu un izmantotu vienā sejas nospiedumā. Neviens algoritms nevar garantēt simtprocentīgu pārliecību par rezultātu, ja kalibrēšana ir tik sarežģīta. Tas galu galā papildina rasu profilēšanu, ko izraisa sejas atpazīšanas tehnoloģija.

Liela uzticamība sejas atpazīšanai

Attēla avots: NY Post

Villija Linča lieta ir atgādinājums, ka sejas atpazīšana nedrīkst būt vienīgā uzticamā metode, kas tiek pasniegta kā pierādījums tiesībaizsardzības jomā. Tas ir iemesls, kāpēc Tampas pilsētas policija atteicās no tehnikas.

Tā ir taisnība, ka sejas atpazīšana ir lielisks kūrorts un palīdz policijai. Bostonas maratona sprādzienu vainīgie tika atzīti, izmantojot plašu un detalizētu novērošanas ierakstu analīzi. Bet tas nevar būt vienīgais pierādījums, lai kādu notiesātu. Jābūt apstiprinošiem pierādījumiem, lai pierādītu sejas atpazīšanas algoritmu rezultātus, un pirms galīgā lēmuma pieņemšanas ir jāņem vērā automatizācijas novirzes jēdziens.

Aparatūras problēma: sejas atpazīšana mobilajās ierīcēs un kamerās

![Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska? Rasu profilēšana sejas atpazīšanas tehnoloģijā: vai sejas atpazīšana var būt rasistiska?]()

Attēla avots: TechCrunch

Novērošanas kameru sistēmas un saistīto aparatūru un programmatūru nav izstrādājis viens uzņēmums. Tā ir miljardiem dolāru vērta nozare, kurā desmitiem korporāciju sacenšas, lai iegūtu līgumus no tiesībaizsardzības iestādēm. Daudzas no šīm sistēmām ir no Ķīnas ražotājiem. Tas viss ir saistīts ar lētāko tehnoloģiju iegūšanu ar vislabākajām īpašībām. Tā tas pārsvarā darbojas. Tāpēc vienmēr pastāv dažādu sistēmu kalibrēšanas atšķirības, kā arī uzraudzības rezultātu kvalitātes atšķirības. Daudzi kameru novērošanas algoritmi ir neefektīvi, lai kalibrētu krāsainu cilvēku attēlus tikai tehniskas nekompetences dēļ, tādējādi slavinot rasu diskrimināciju.

Tehnoloģiskās problēmas, kas izraisa rasismu, izmantojot sejas atpazīšanu, ir pamanītas arī Apple Face Lock funkcijā. Lietā no Ķīnas tika izslēgts, ka iPhone X sejas bloķētājs nespēja atšķirt divus dažādus ķīniešu kolēģus, padarot šo funkciju bezjēdzīgu. Līdzīgi ziņojumi tika noraidīti, atsaucoties uz problēmām, kas saistītas ar divu melnādainu cilvēku atdalīšanu vienu no otra. Kā minēts iepriekš, Apple tehniskajās komandās ir tikai 6% melnādaino cilvēku. Tas ir skaidrs piemērs tam, kā sejas atpazīšanas tehnoloģija var veicināt rasismu pat mūsu rokas ierīcēs.

Secinājums

Jā, sejas atpazīšana ir rasistiska, un tagad tas ir vispārzināms. Lai gan tehnoloģija katru dienu attīstās, lai novērstu šādas problēmas, rezultāti ir vienādi. Paredzams, ka tehnoloģijām ir jāapvieno pasaule, lai sasniegtu kopīgus tehniskos sasniegumus un attīstību, taču daži paņēmieni tikai nodara kaitējumu rasu un kopienas harmonijai.

Pagaidām labākais, ko tiesībaizsardzības iestāžu darbinieki var darīt, ir neatbalstīt savas lietas, pamatojoties uz pierādījumiem no algoritmiskās kalibrēšanas, kas pat nav uzticami. Turklāt ir pēdējais laiks nopietni uztvert dažādību un iekļaušanu darba vietās, lai dažādu etnisko piederību cilvēki varētu sanākt kopā, lai radītu produktu, kurā nav rasu atšķirības. Pasaulē ir tūkstošiem rasu, un cilvēki ir pieauguši, lai noliktu malā rasu atšķirības, kas tik ilgi vajāja globālo sabiedrību. Ja tas ir jāsaglabā, tad mašīnas, uz kurām mēs tik ļoti paļaujamies, ir jāmāca tāpat.